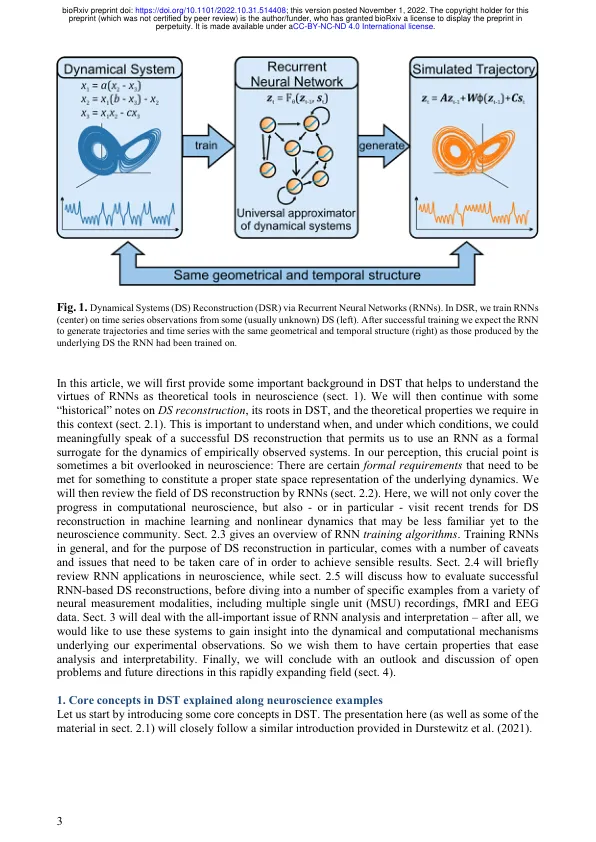

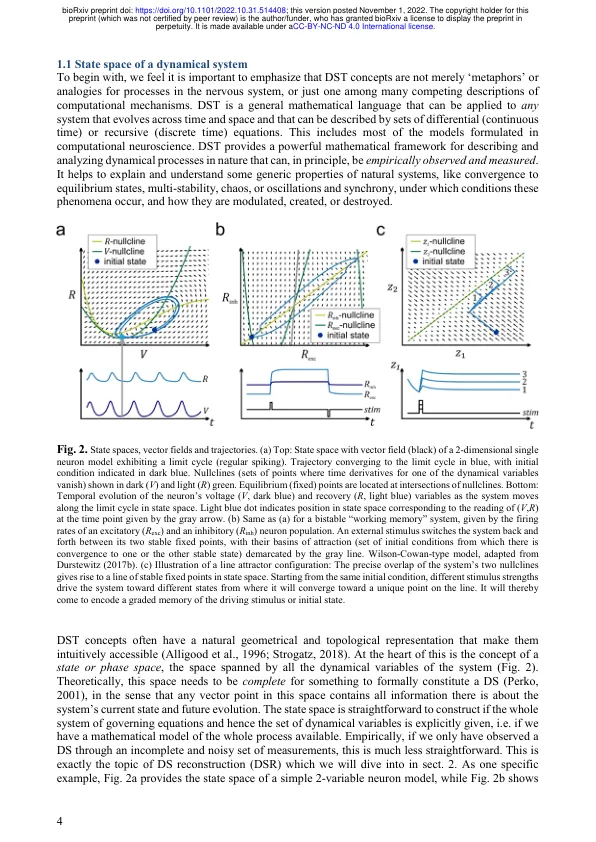

使用循环神经网络从神经测量重建计算动力学 Daniel Durstewitz 1,2,3,*、Georgia Koppe 1,4、Max Ingo Thurm 1 1 海德堡大学医学院中央精神卫生研究所理论神经科学系 2 海德堡大学跨学科科学计算中心 3 海德堡大学物理与天文学院 4 海德堡大学医学院中央精神卫生研究所精神病学和心理治疗诊所* 通讯作者:daniel.durstewitz@zi-mannheim.de 关键词:动力系统理论、机器学习、循环神经网络、吸引子、混沌、多个单元记录、神经生理学、神经成像 摘要 神经科学中的机械和计算模型通常采用微分或时间递归方程组的形式。此类系统的时空行为是动力系统理论 (DST) 的主题。 DST 提供了一个强大的数学工具箱,用于描述和分析从分子到行为的任何级别的神经生物学过程,几十年来一直是计算神经科学的支柱。最近,循环神经网络 (RNN) 成为一种流行的机器学习工具,用于研究神经或行为观察背后的非线性动力学。通过在与动物受试者相同的行为任务上训练 RNN 并剖析其内部工作原理,可以产生关于行为的神经计算基础的见解和假设。或者,可以直接在手头的生理和行为时间序列上训练 RNN。理想情况下,一旦训练好的 RNN 将能够生成具有与观察到的相同的时间和几何属性的数据。这称为动态系统重建,这是机器学习和非线性动力学中一个新兴的领域。通过这种更强大的方法,就其动态和计算属性而言,训练过的 RNN 成为实验探测系统的替代品。然后可以系统地分析、探测和模拟训练过的系统。在这里,我们将回顾这个令人兴奋且迅速发展的领域,包括机器学习的最新趋势,这些趋势在神经科学中可能还不太为人所知。我们还将讨论基于 RNN 的动态系统重建的重要验证测试、注意事项和要求。概念和应用将通过神经科学中的各种示例进行说明。简介理论神经科学的一个长期原则是,神经系统中的计算可以用底层的非线性系统动力学来描述和理解(Amit & Brunel,1997;Brody & Hopfield,2003;Brunel,2000;Durstewitz,2003;Durstewitz 等,1999、2000、2021;Hodgkin & Huxley,1952;Hopfield,1982;Izhikevich,2007;Machens 等,2005;Miller,2016;Rinzel & Ermentrout,1998;Wang,1999,2002;Wilson,1999;Wilson & Cowan,1972)。相关思想可以追溯到 40 年代 McCulloch & Pitts (1943)、Alan Turing (1948) 和 Norbert Wiener (1948) 的工作,并在 80 年代早期通过 John Hopfield (1982) 的开创性工作获得了发展势头,该工作将记忆模式嵌入为简单循环神经网络中的固定点吸引子。Hopfield 网络的美妙之处在于它们免费提供了生物认知系统的许多特性,例如自动模式完成、通过部分线索进行内容可寻址记忆检索或对部分病变和噪声的鲁棒性。通过动态系统理论 (DST) 的视角来观察神经计算特别有力,因为一方面,许多(如果不是大多数)物理和生物过程都是自然形式化的

利用循环神经网络从神经测量中重建计算动力学

主要关键词