机构名称:

¥ 1.0

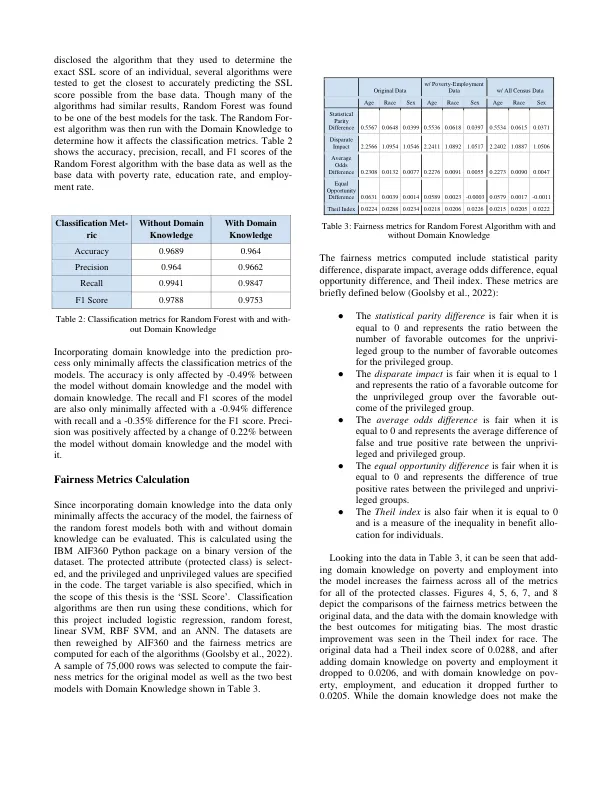

摘要作为越来越多的人工智能(AI)系统在我们的日常生活中根深蒂固,至关重要的是,它们是公平和值得信赖的。不幸的是,预测性警务系统通常不是这种情况,在这种情况下,对年龄以及种族和性别存在偏见,导致许多人被错误地标记为犯罪的可能性。在已经因其对少数群体的不公正待遇而受到批评的系统中,找到减轻这种负面趋势的方法至关重要。在这项工作中,我们探索并评估了预测性警务系统中域知识的输液,以最大程度地减少普遍的公平问题。实验结果表明,所有专业阶级的所有指标中的公平性表明,通过减少人们的不公平警务,将更多的信任带入了预测性警务系统。

使用域知识评估预测性警务中的公平性