机构名称:

¥ 1.0

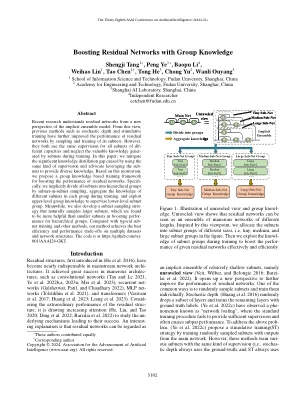

最近的研究从隐式集成模型的新角度了解残差网络。从这种角度来看,诸如随机深度和刺激训练之类的先前方法通过对其子网进行采样和训练进一步提高了残留网络的性能。但是,他们都使用相同的监督对所有不同能力的子网,并忽略了子网在培训期间所产生的宝贵知识。在本文中,我们减轻了通过使用相同类型的监督引起的重要知识蒸馏差距,并主张利用子信息提供多样化的知识。基于这种动机,我们提出了一个基于群体知识的培训框架,以提高剩余网络的性能。具体说明,我们将所有子网隐式将所有子网分为层次组,通过子网中的抽样采样,在培训过程中汇总每个组中不同子网的知识,并利用高级组知识来监督下级子网组。同时,我们还开发了一个自然采样较大子网的子网采样策略,在增强层次组的性能中比较小的子网更有帮助。与典型的子培训和其他方法相比,我们的方法在多个数据集和网络结构上实现了最佳效率和性能权衡。代码位于https://github.com/tsj- 001/aaai24-gkt。

用小组知识促进残留网络