机构名称:

¥ 1.0

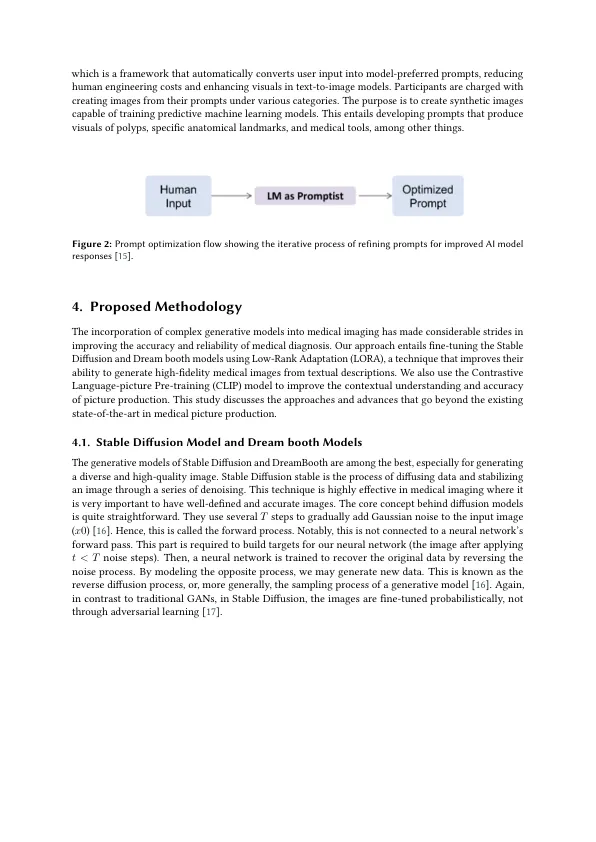

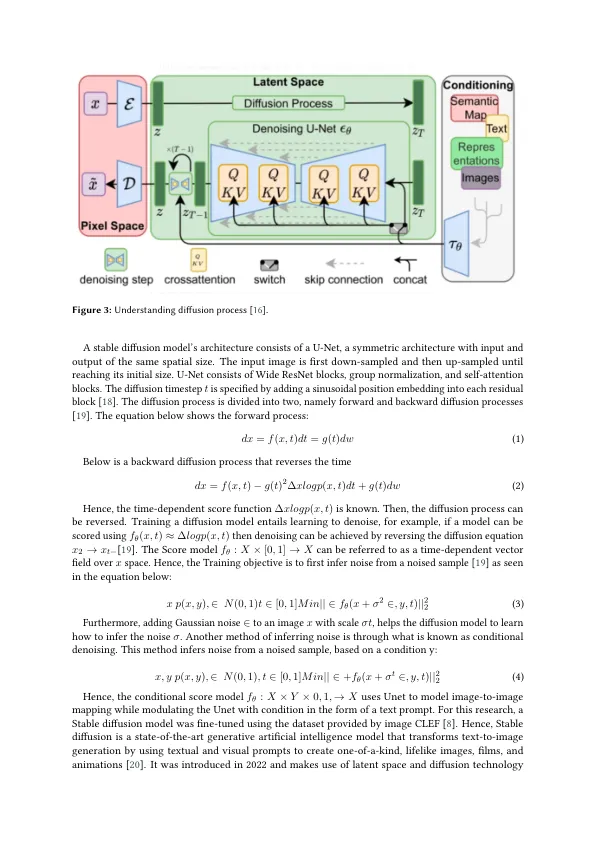

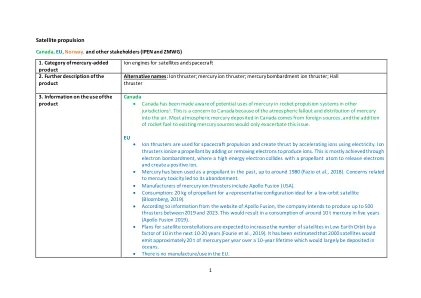

摘要MEDVQA-GI挑战挑战解决了AI驱动的文本对象生成模型在医学诊断中的集成,旨在通过合成图像生成来增强诊断能力。现有方法主要集中于静态图像分析,并且缺乏文本描述中医学图像的动态生成。本研究打算通过引入基于微调生成模型的新方法来部分缩小这一差距,以从文本描述中生成动态,可扩展和精确的图像。尤其是,我们的系统集成了微调的稳定扩散和Dreambooth模型,以及低级适应(LORA),以生成高保真的医学图像。问题是两个子任务,即:图像合成(IS)和最佳提示生产(OPG)。前者通过口头提示创建医学图像,而后者提供了在指定类别中产生高质量图像的提示。这项研究强调了传统医学图像生成方法的局限性,例如手绘,限制数据集,静态程序和通用模型。我们的评估措施表明,稳定的扩散在产生高质量,多样化的图像方面超过了夹子和Dreambooth + Lora。具体来说,稳定的扩散的限制距离(FID)得分最低(单中心为0.099,多中心为0.064,合并为0.067),表明图像质量更高。此外,它的平均成立得分最高(所有数据集中为2.327),表明了异常的多样性和质量。这进展了AI驱动的医疗诊断领域。未来的研究将集中于模型炼油,数据集扩展和道德考虑,以有效地将这些进步实施到临床实践中。

推进AI驱动的医疗图像合成

主要关键词