机构名称:

¥ 1.0

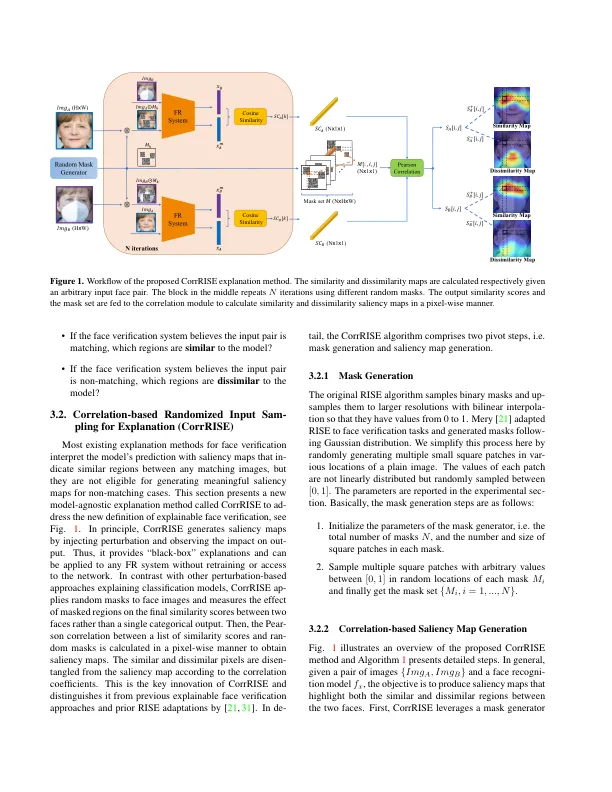

在过去的几年中,深度卷积神经网络一直在验证和识别场景中推动面部识别(FR)技术的边界。尽管准确性很高,但他们经常因缺乏解释性而受到批评。对了解深面识别系统的决策过程的需求越来越不断增加。最近的研究调查了视觉显着性图作为一种解释,但在面部识别的背景下,它们通常缺乏讨论和分析。本文集中于可解释的面部验证任务,并想出了新的解释框架。首先,提供了基于显着的解释方法的定义,该方法的重点是深FR模型做出的决策。其次,提出了一种名为corrrise的新型模型不合时宜的方法来产生显着图,该图显示了任何给定的面部图像的相似区域和不同区域。然后,一种评估方法旨在衡量面部验证中一般视觉显着性解释方法的性能。最后,实质性的视觉和定量结果表明,与其他可解释的面部验证方法相比,提出的Corrrise方法具有有希望的结果。

朝着面部验证的视觉显着性解释