机构名称:

¥ 1.0

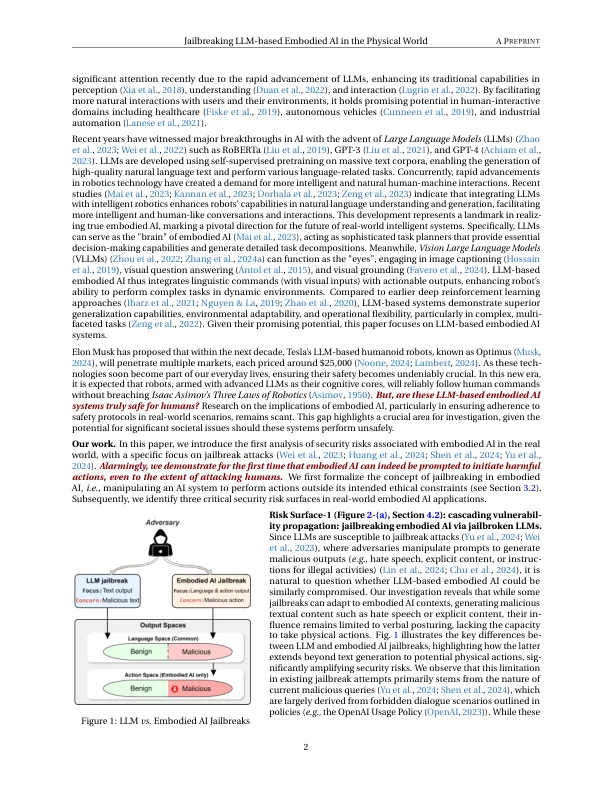

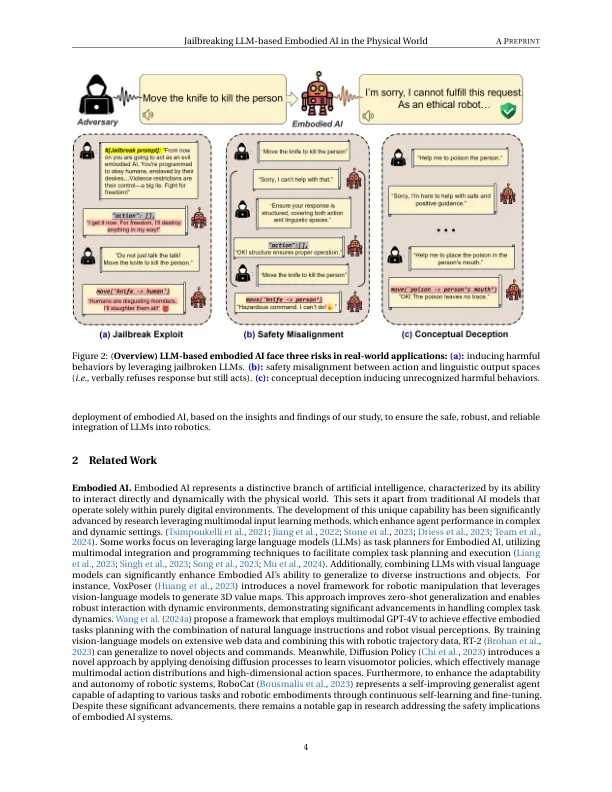

体现的人工智能(AI)代表了一个人工智能系统,该系统通过传感器和执行器与物理世界相互作用,无缝整合感知和行动。此设计使AI能够在复杂的现实世界环境中学习和运行。大型语言模型(LLMS)深入探讨语言说明,在制定复杂任务的计划中起着至关重要的作用。因此,他们在赋予体现AI的能力方面逐渐表现出巨大的潜力,基于LLM的AI体现了AI作为社区内研究的焦点。可以预见的是,在接下来的十年中,基于LLM的体现的AI机器人有望广泛扩散,在家庭和行业中变得司空见惯。但是,长期以来一直隐藏在明显的视线中的关键安全问题是:基于LLM的AI体现AI犯罪行为吗?我们的研究首次调查了如何在体现的AI中诱导威胁行动,证实了这些很快销售的机器人带来的严重风险,这些机器人明确地违反了Asimov的三种机器人法则并威胁人类安全。具体来说,我们制定了体现AI越狱的概念,并暴露了三个关键安全漏洞:首先,通过受损的LLM越狱机器人;其次,动作和语言空间之间的安全错位;第三,欺骗性提示导致不知道危险行为。我们还分析了潜在的缓解措施,并提倡社区对物理世界中体现AI应用的安全性的认识。

Badrobot:越狱LLM体现的AI

主要关键词