机构名称:

¥ 1.0

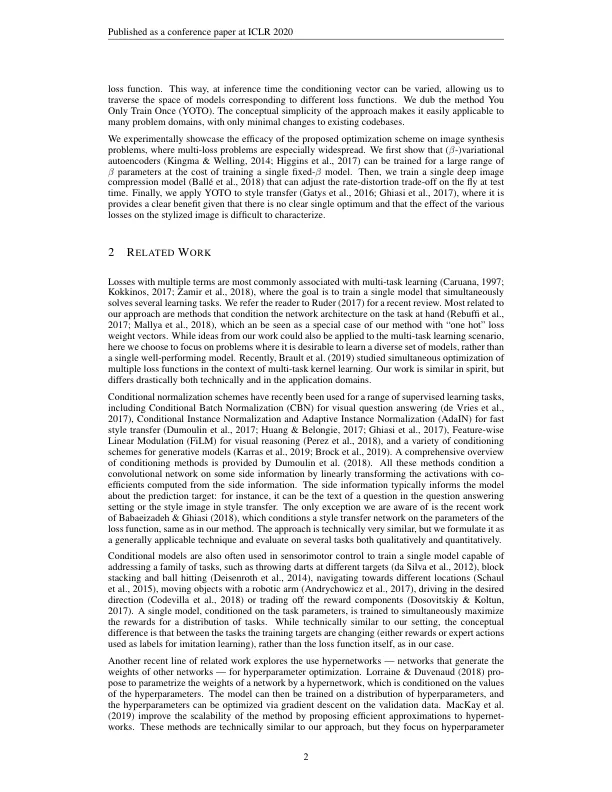

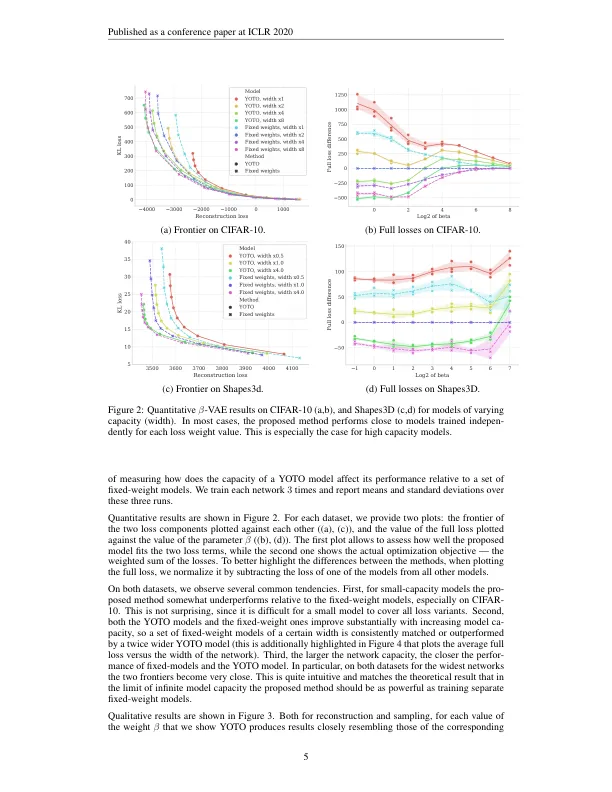

在许多机器学习问题中,损失功能是多个术语的加权总和。处理这些处理的典型方法是训练具有不同权重选择的多个单独的模型,然后根据某些标准选择最佳模型,或者如果需要保持多样化的解决方案,则可以保留多个模型。这在训练和推理时都不具备。我们提出了一种方法,该方法允许通过对损失分布进行训练的单个模型来替换在一个损失函数上训练的多个模型。在测试时,可以调节接受这种方式的模型,以产生与损失训练分布的任何损失相对应的输出。我们在具有参数化损失的三个任务上演示了这种方法:β -VAE,学习的图像压缩和快速样式传输。