机构名称:

¥ 1.0

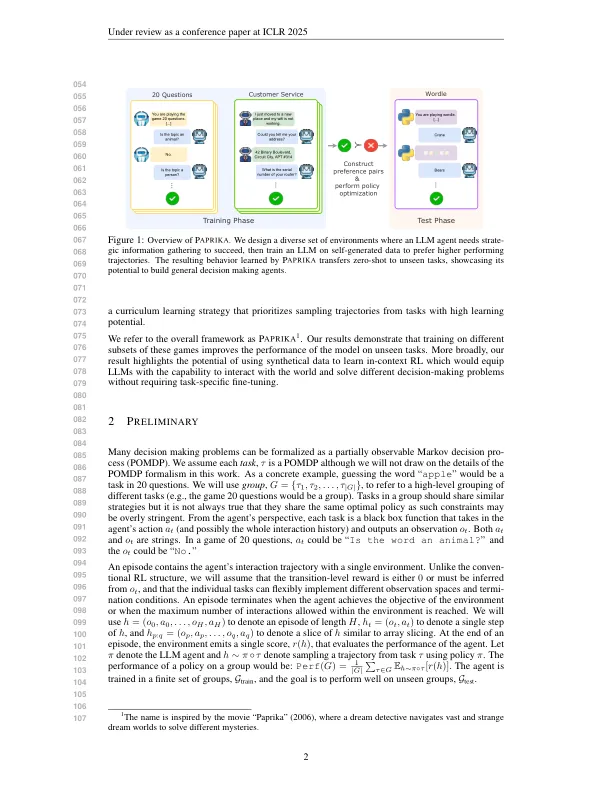

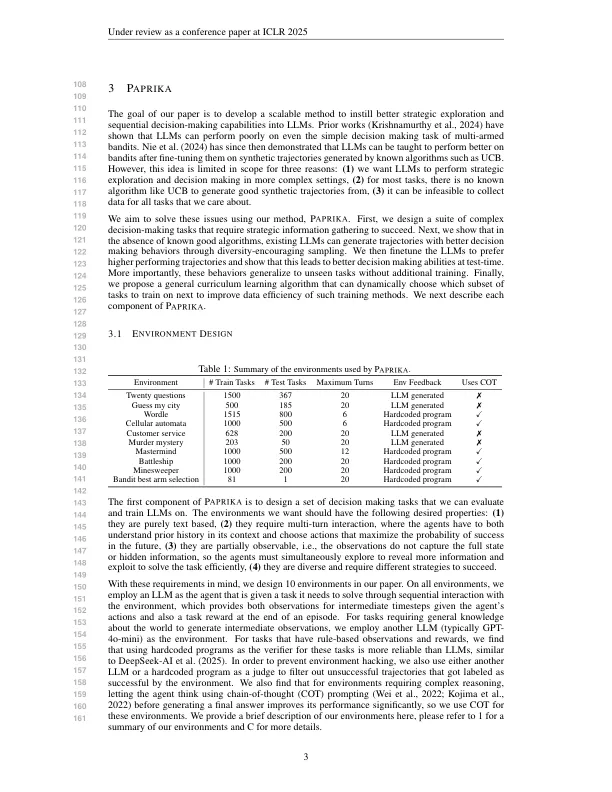

有效的探索对于与其环境相互作用的智能系统至关重要,但是现有的语言模型通常在需要战略信息收集的场景中不足。在本文中,我们提出了P aprika,这是一种微调方法,使语言模型能够开发不限于特定环境的一般决策能力。通过培训来自不同任务的合成互动数据,这些数据需要各种策略,P Aprika教授模型,以探索和调整其行为,以基于环境回馈的情况,而无需梯度更新。实验结果表明,用P Aprika进行微调的模型可以有效地将其学到的决策能力传递到完全看不见的任务的情况下,而无需额外的培训。我们还介绍了一种提高P Aprika样品效率的课程学习算法。这些结果提出了通往AI系统的有希望的途径,该系统可以自主解决需要与外部世界相互作用的新型顺序决策问题。

培训通常好奇的代理商

主要关键词