机构名称:

¥ 3.0

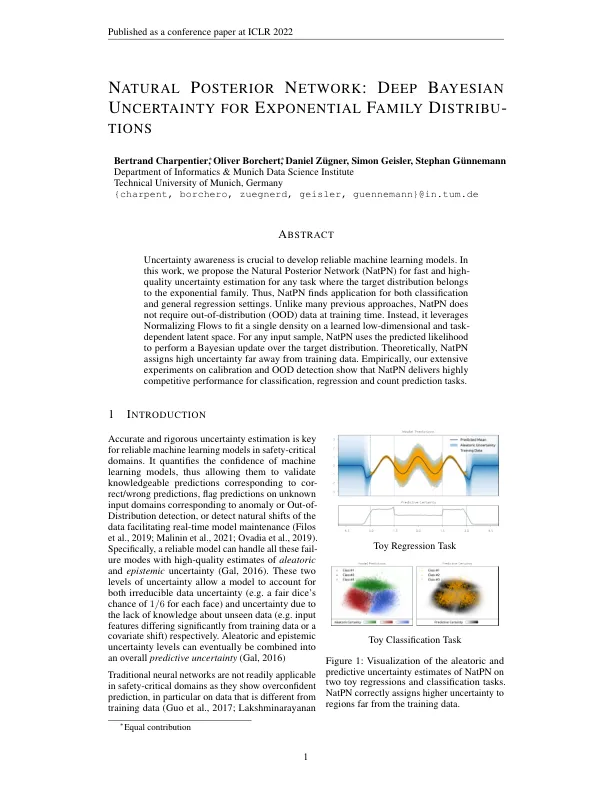

不确定性意识对于开发可靠的机器学习模型至关重要。在这项工作中,我们建议对目标分布属于指数族的任何任务的快速和高质量不确定性估计进行自然后网络(NATPN)。因此,NATPN发现用于分类和常规回归设置的应用。与以前的许多方法不同,NATPN在培训时不需要分发(OOD)数据。取而代之的是,它利用标准化流量将单个密度拟合在学习的低维和依赖性潜在空间上。对于任何输入样本,NATPN使用预测的可能性对目标分布进行贝叶斯更新。从理论上讲,NATPN分配了远离培训数据的高不确定性。从经验上讲,我们对校准和OOD检测的广泛实验表明,NATPN为分类,回归和计数预测任务提供了高度竞争性的绩效。

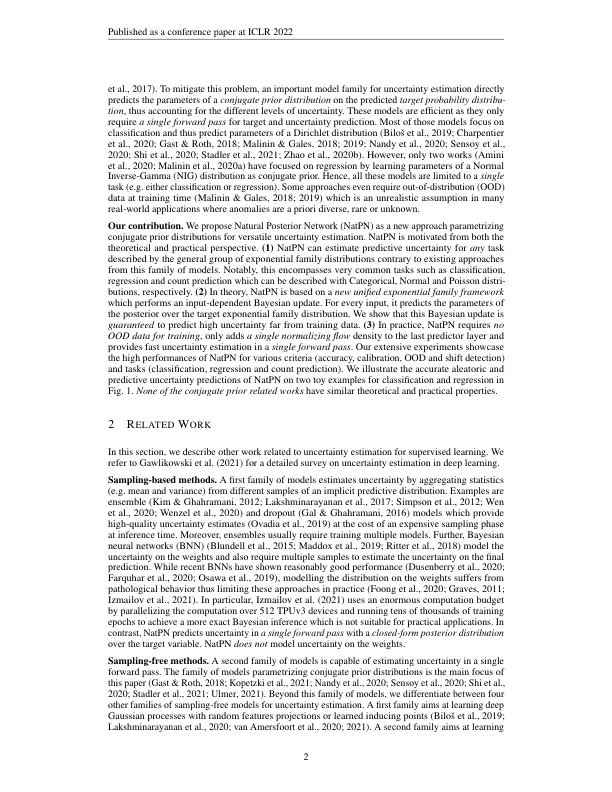

自然后网络:深贝叶斯...