机构名称:

¥ 1.0

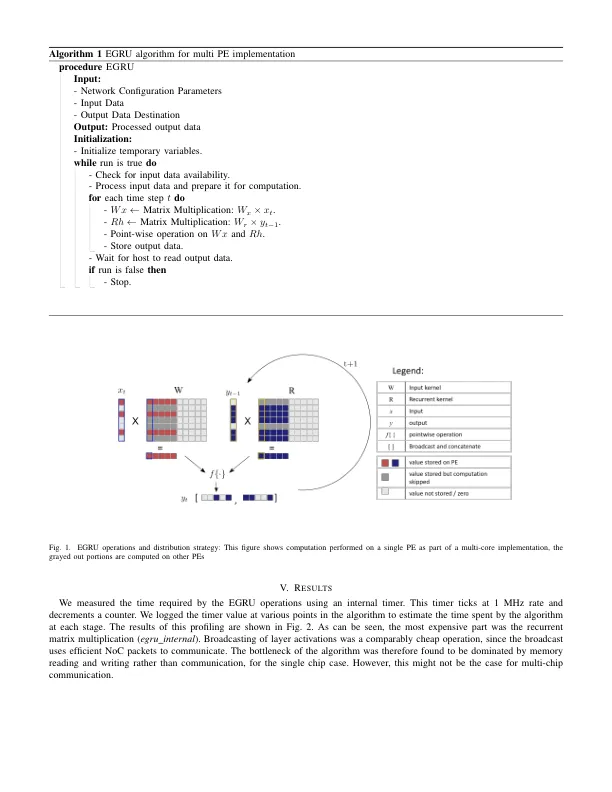

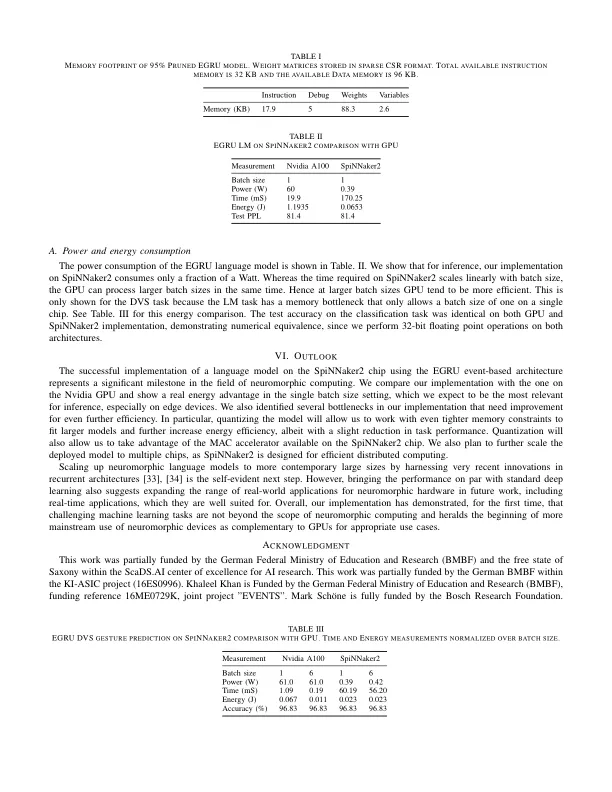

随着大型语言模型的规模继续迅速扩展,运行它们所需的计算能力也是如此。基于事件的神经形态设备的网络提供了一种潜在的方法来大大减少推理的能源消耗。迄今为止,大多数基于事件的网络都可以在包括尖峰神经网络(SNNS)在内的神经形态硬件上运行,即使与LSTM模型相当,也无法实现任务性能。结果,对神经形态设备的语言建模似乎是一个遥远的前景。在这项工作中,我们基于最近发表的基于事件的架构The Egru,演示了在神经形态设备(特别是Spinnaker2芯片)上的第一个语言模型实现。spinnaker2是一种多核神经形态芯片,设计用于大规模异步处理,EGRU构建以有效地利用此类硬件,同时保持竞争性任务绩效。此实现标志着神经形态语言模型首次与LSTM匹配,为将任务性能带到大语言模型的级别设定了阶段。我们还根据DVS摄像机的输入来展示对手势识别任务的结果。总的来说,我们的结果展示了这种神经启发的神经网络在硬件中的可行性,强调了单批推断的常见用例的能源效率的显着增长与常规硬件的可行性。

Spinnaker上的语言建模2神经形态芯片

主要关键词