机构名称:

¥ 1.0

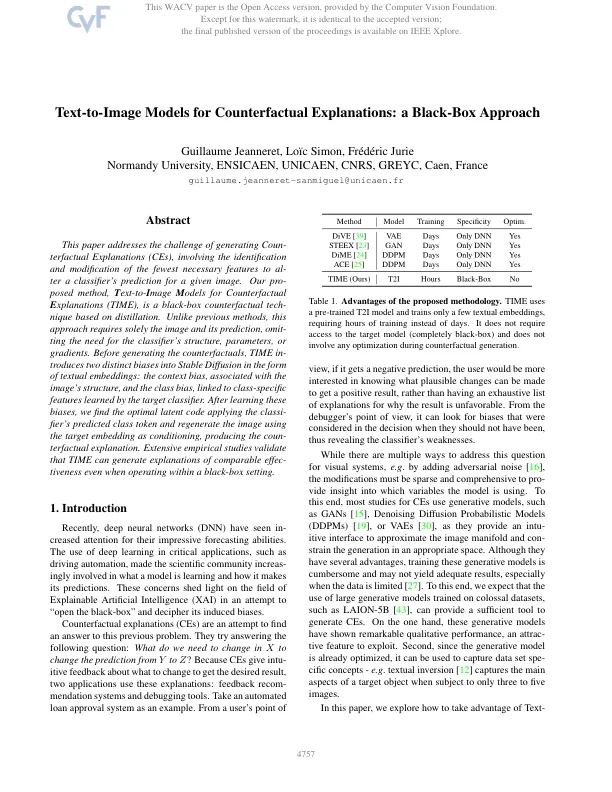

本文解决了生成法定说明(CES)的挑战,涉及识别和修改最少的必要特征,以使分类器对给定图像的预测进行预测。我们提出的方法是反事实e xplanations(Time)的tept to-i mage m odels,是一种基于蒸馏的黑盒反事实技术。与以前的方法不同,此方法仅需要图像及其预测,从而忽略了分类器的结构,参数或梯度的需求。在生成反事实之前,时间将两个不同的偏见引入了文本嵌入的形式稳定扩散:与图像的结构相关联的上下文偏差和类别偏见,与目标分类器学到的类特异性特征相关。学习了这些偏见后,我们发现了使用类预测的类令牌的最佳潜在代码,并使用目标嵌入作为条件,从而产生了符合性的解释。广泛的经验研究证明,即使在黑色盒子设置中运行时,时间也可以产生可比性的解释。

反事实说明的文本到图像模型

主要关键词