机构名称:

¥ 1.0

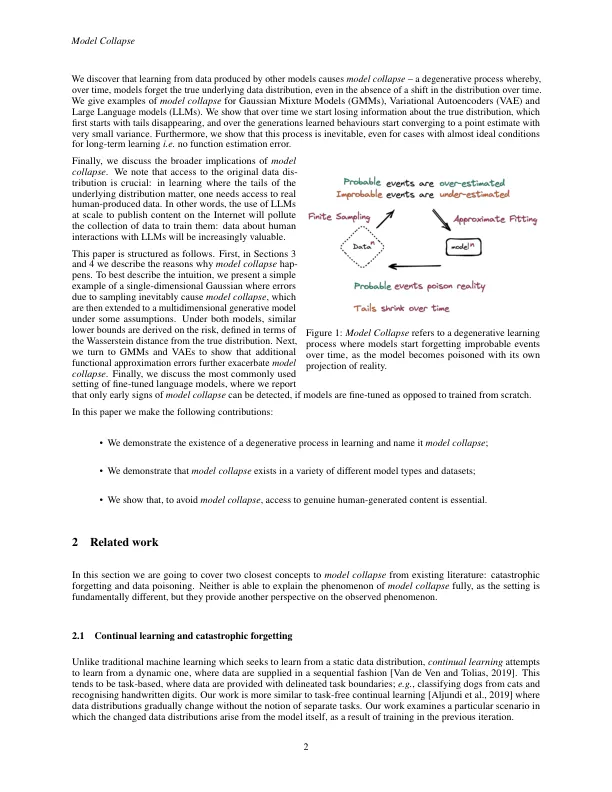

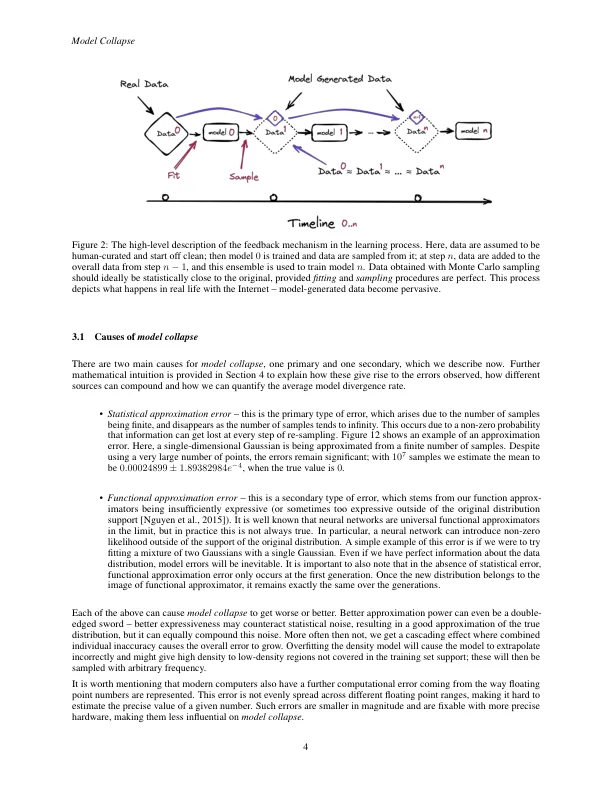

稳定的扩散从描述性文本彻底改变了图像创建。GPT-2,GPT-3(.5)和GPT-4在各种语言任务中表现出惊人的表现。chatgpt向公众介绍了此类语言模型。现在很明显,大型语言模型(LLMS)将留在这里,并且会在整个在线文本和图像的生态系统中产生巨大的变化。在本文中,我们考虑未来可能会有什么。一旦LLM在网上找到大部分语言,GPT- {N}会发生什么?我们发现,在训练中使用模型生成的内容会导致不可逆的缺陷,其中原始内容分布的尾巴消失了。我们将这种效果称为模型崩溃1,并表明它可以在变异自动编码器,高斯混合模型和LLM中发生。我们建立了这种现象背后的理论直觉,并在所有学到的生成模型中描绘了它的普遍性。我们证明,如果我们要维持从网络上刮除的大规模数据培训的好处,则必须认真对待它。的确,在LLMS在从Internet爬网的数据中产生的内容的存在下,收集到有关人类与系统的真正人类互动的数据的价值将变得越来越有价值。

对生成数据的培训使模型忘记

主要关键词