机构名称:

¥ 1.0

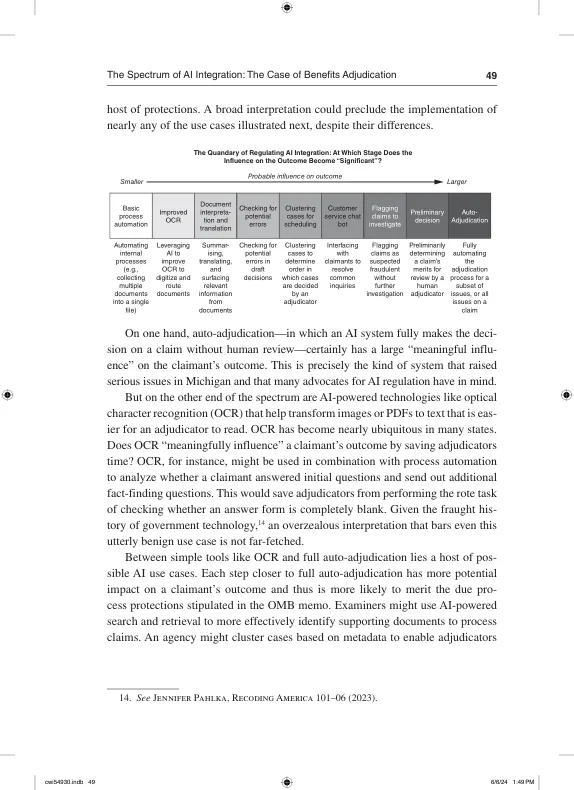

人工智能监管的核心举措是使用人工智能时触发一系列最低限度的流程、保护和保障措施,比如退出机制、人工审查权利和公众咨询。我们认为,这一举措是错误的,原因很简单:人工智能不是铁板一块。通过采取严格的“基于权利”的人工智能监管方式,这种方法可能无法吸取最高法院程序正当程序革命的教训,该革命警告说,为了避免政府陷入停顿,流程必须根据所涉及的风险水平量身定制。1人工智能也是如此。我们用福利裁决的案例来说明这一挑战——许多人认为应该对人工智能的使用适用广泛的程序。我们展示了跨应用的广泛风险,我们将其称为人工智能集成的范围,以及许多监管干预措施如何与人工智能集成的现实不相适应。虽然单一领域(福利裁定)可能被称为“高风险”,但人工智能集成的范围意味着领域内的风险差异可能比领域间差异更相关(且更高)。如果监管不力,将损害急需的现代化努力。

人工智能集成的范围:福利裁决案例