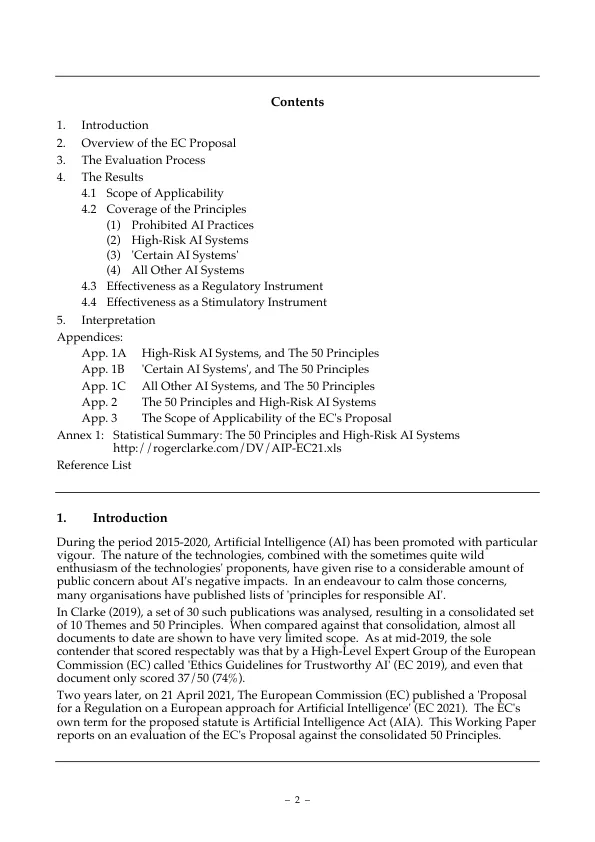

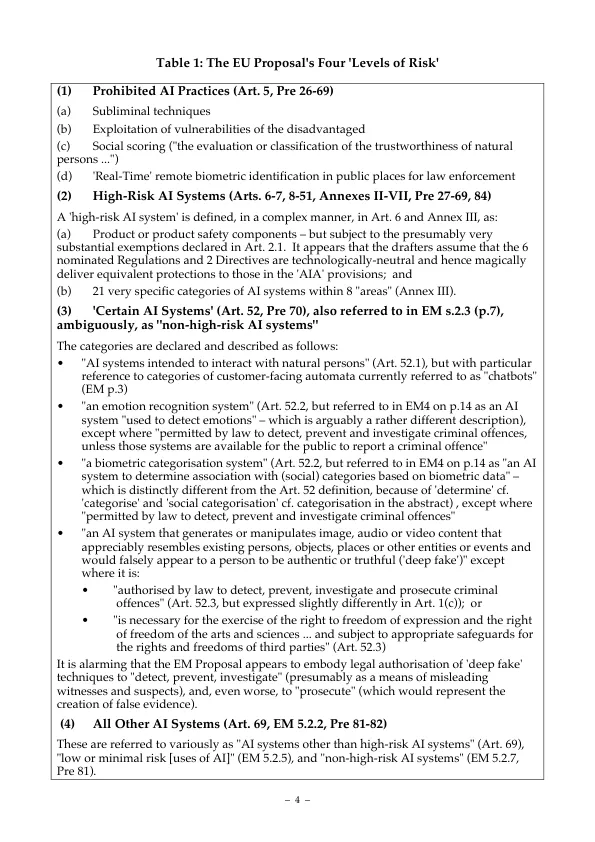

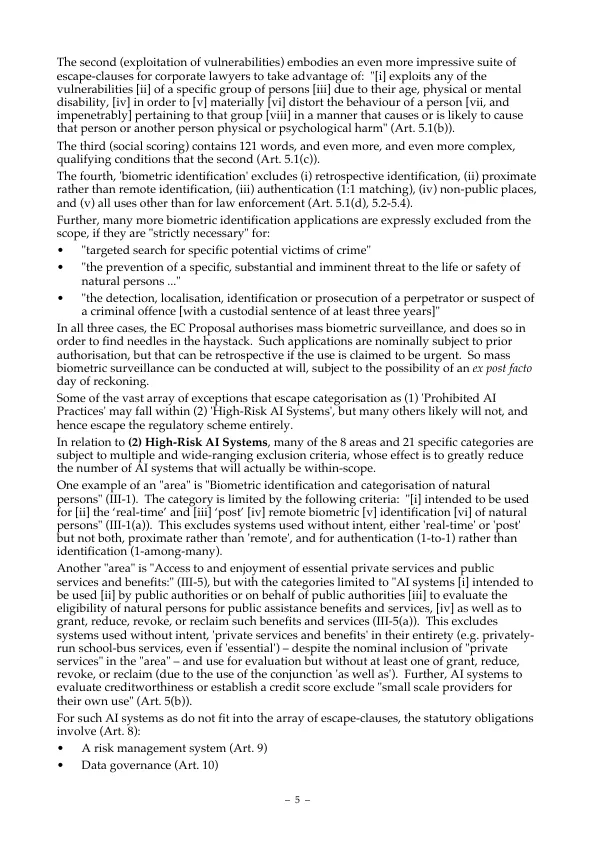

2019 年 4 月,欧盟委员会发布了高级专家组的《可信人工智能道德准则》。两年后,即 2021 年 4 月,欧盟委员会宣布了“人工智能卓越和信任的新规则和行动”,旨在“确保欧洲人能够信任人工智能所提供的一切”。该声明激发了公众和公共利益倡导团体的热情,他们一直非常担心人工智能行业支持者试图实施危险技术。本工作文件介绍了对欧盟委员会 2021 年提案的评估结果。使用的主要基准是一套“负责任人工智能的 50 条原则”。这是从 2019 年年中 30 份此类文件的大量样本中整合而成的。 “50 项原则”此前曾被用于评估许多“道德准则”,包括欧盟委员会在 2019 年发布的准则。需要一种定制的评估方法,因为欧盟委员会的提案是首次发布立法草案,而且“人工智能系统”的核心概念的定义与传统用法不一致。评估结果并不支持欧盟委员会提案能够带来可信度的说法——尽管它可以通过误导公众信任人工智能,对人工智能支持者产生公关价值。欧盟委员会提案的有效性体现在一系列特点上,这些特点使其作为一项监管措施几乎完全没有价值。致命的弱点包括范围限制;关键术语的使用非常规;对可能非常大量的“人工智能系统”没有任何保护措施;对一小部分旨在直接与人互动的系统类别施加了单一、非常弱的要求;对于欧盟委员会所称的有限范围的“高风险”系统,其保护措施非常薄弱、模糊,在许多情况下可能无法执行;没有要求人工智能系统得出的推论必须能够得到合理解释;个人或其倡导者没有能力寻求纠正和补救错误的推理。欧盟委员会 2019 年的“道德准则”与欧盟委员会 2021 年的提案之间存在的差距表明,在政府机构和企业用户的支持下,人工智能行业的呼吁导致专家组完全被忽视,并且过于重视行业刺激,以至于社会考虑被降级为制约因素,导致法规草案基本上是空洞的。

欧盟委员会关于人工智能监管的提案 - Roger Clarke

主要关键词