机构名称:

¥ 1.0

作为编辑,当《自然》(Else,2023 年)报道了一项研究时,ChatGPT 引起了我们的注意,在该研究中,研究人员要求聊天机器人在医学研究领域撰写摘要。随后,要求人类审阅者在一批原始和生成的摘要中识别这些摘要。审阅者仅正确识别了 68% 的生成摘要,并错误地将 14% 的原始摘要识别为生成的。此外,生成的摘要被抄袭检测器认定为原创(有关详细信息,请参阅 Gao、Howard、Markov、Dyer、Ramesh、Luo 和 Pearson,2022 年)。与此相关,一周后,《自然》(Stokel-Walker,2023 年)报道 ChatGPT 成为几篇学术论文的合著者。因此,我们也必须考虑对 IJRM 的直接影响。ChatGPT 可以成为合著者吗?我们应该如何进行人工智能生成的文献综述?虽然我们在下面阐述了我们对该期刊的相应观点和政策,但我们也看到了更根本的讨论的必要性和机会,即 ChatGPT 和其他形式的生成人工智能 (GenAI) 对研究、教学和商业实践的更大、长期影响。我们在本社论中提供了一个起点,并探讨了 GenAI 的一些机遇和威胁,包括该领域未来研究项目的想法。

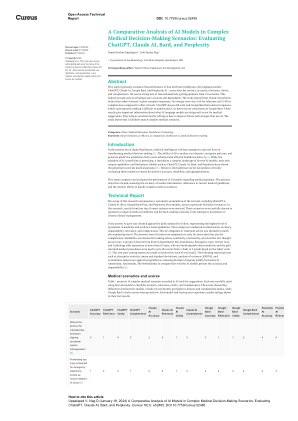

关于 ChatGPT 及其他