机构名称:

¥ 2.0

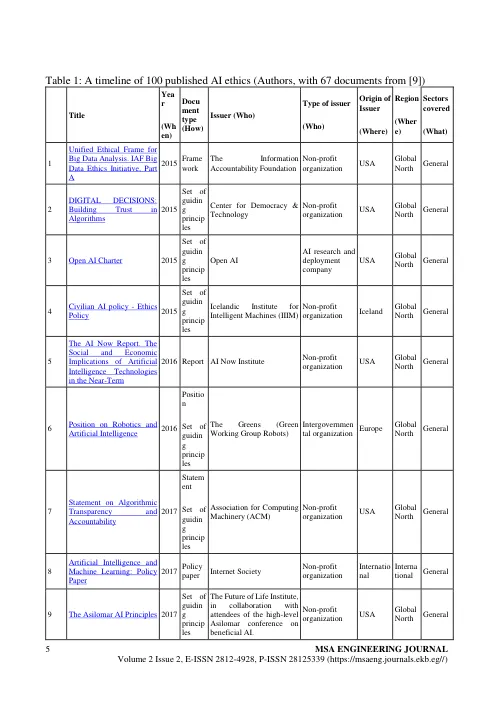

人工智能伦理是一个相对新兴的领域,目前已经制定了多项关于人工智能伦理的指南、报告、声明和倡议。尽管近年来人工智能伦理的产出有所增加,但文献中没有系统的跟踪来深入研究人工智能伦理的产出环境。一些先前的研究介绍了文件的地理位置和日期,但是,关于人工智能伦理文件的必要信息仍然缺失,例如它们的类型、发布者以及涵盖和缺失的部门。因此,我们分析了 2015 年至 2022 年期间各组织发布的 100 份关于人工智能伦理的文件的数据集。该分析的目的是提供当前人工智能伦理格局的全面视图。我们使用内容分析来突出数据集的五个关键元素:发布时间段(何时)、关于人工智能伦理的文件类型(如何)、发布者类型(谁)、地理分布(哪里)以及它们涵盖的部门(什么)。研究结果显示,2015 年是发布 AI 伦理文件的元年,2018 年是发布 AI 伦理文件的高峰年。大多数文件都是指导原则集,其次是报告和其余文件类型。此外,大多数 AI 伦理文件是由私人实体制定的,其次是学术界和政府实体。此外,我们注意到一个差距,即大多数 AI 伦理文件都是由全球北方的实体和组织制定的。最后,大多数 AI 伦理文件都是通用的,并不关注某个特定领域。尽管如此,还是有一些文件是针对特定领域(如医疗、移动/自动交通和教育)创建的。尽管如此,AI 伦理文件仍然是不具约束力的指导方针,这引发了一些关于 AI 伦理在现实中的适用性的问题。关键词:人工智能、AI 伦理、负责任的 AI、道德 AI。

人工智能伦理盘点:分析 100 份文件

主要关键词