机构名称:

¥ 1.0

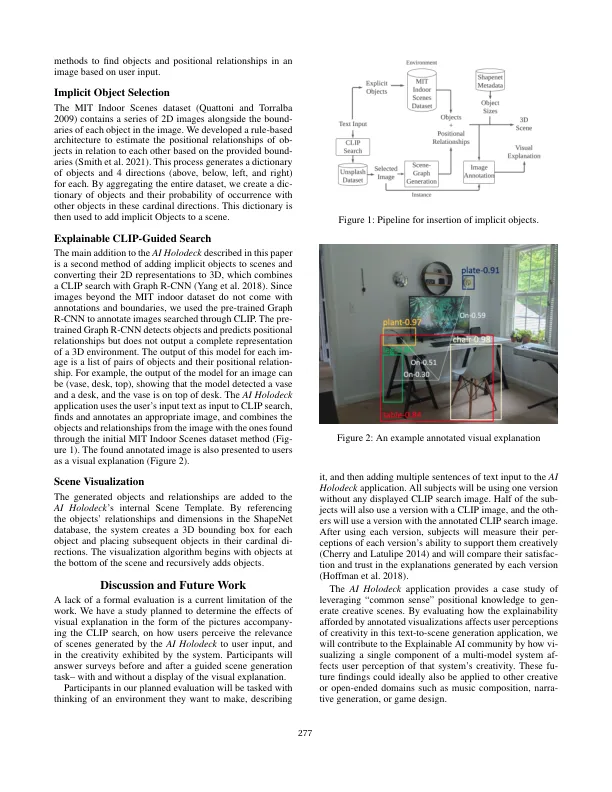

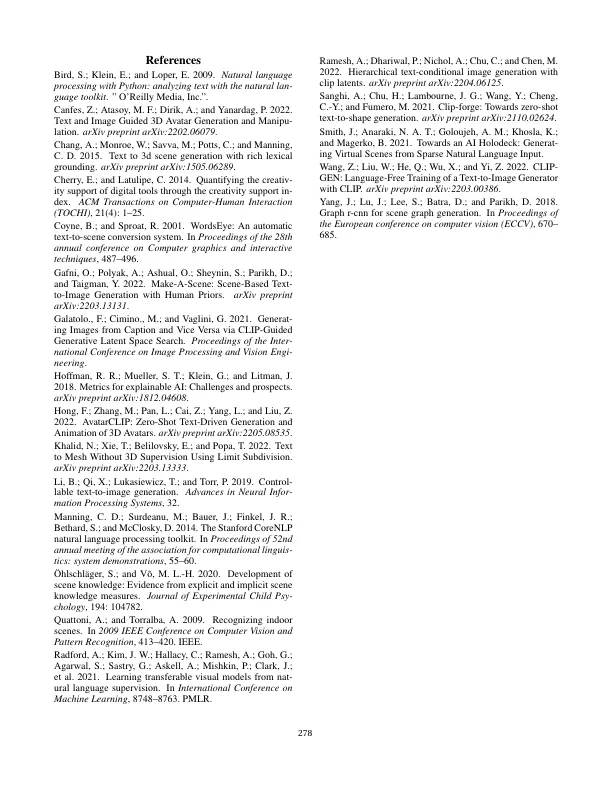

简介文本到场景生成的一个主要挑战是生成多样化但又与用户输入保持相关的场景。 先前关于 3D 场景生成的工作主要集中于使用用户明确提到的对象或相关对象(而不考虑基础环境)的场景的可信度(Chang 等人,2015 年;Coyne 和 Sproat,2001 年)。 然而,虚拟场景也可以包含隐式对象(即通过常识与其他对象相关并从隐式场景知识中得出的对象(¨ Ohlschl¨ager 和 V˜o,2020))。 隐式对象可以通过特定于环境或特定于实例的知识收集,并且可以通过描绘多样化和人口密集的物理空间的真实感来提高生成场景的可信度。我们之前曾介绍过 AI Holodeck (Smith 等人,2021) 的初始阶段,这是一个使用通过带注释的数据集收集的环境特定知识从自然语言输入生成虚拟 3D 场景的应用程序。在本文中,我们介绍了 AI Holodeck 应用程序的新版本,它通过两个层次收集常识性知识。首先,如前一版本所示,带注释的图像数据集为系统提供了与用户明确定义的对象隐式相关的对象。其次,CLIP 引导 (Radford 等人,2021) 搜索从与用户输入相关的参考图像中提取对象及其空间关系。由于存在令人惊讶的隐式对象或其位置,这一添加也增加了我们系统对可解释性的需求。对于

可解释的 AI Holodeck 中的 CLIP 引导 3D 场景生成

主要关键词