机构名称:

¥ 2.0

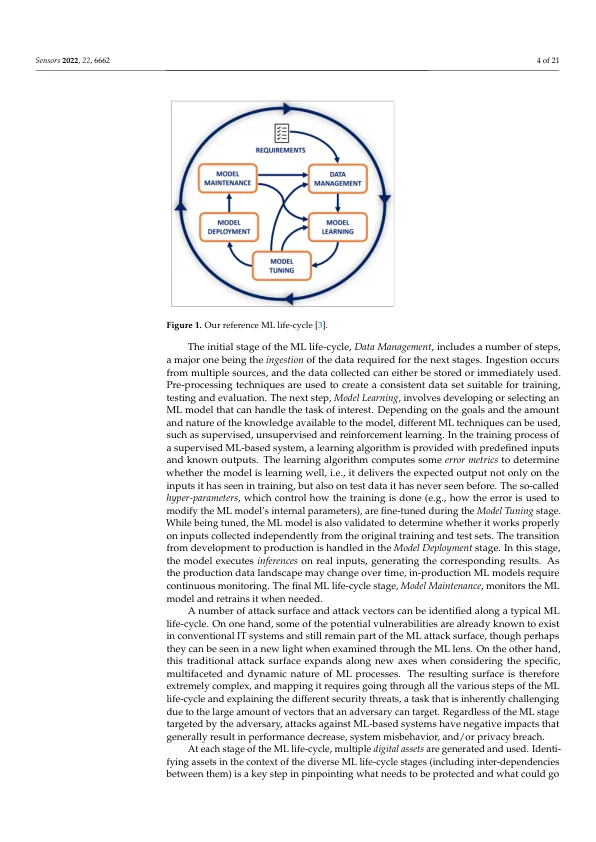

摘要:人工智能 (AI) 等新兴技术的应用会带来风险,需要加以解决,以确保社会技术基础设施的安全可信。机器学习 (ML) 是 AI 最发达的子领域,可以改善决策过程。但是,ML 模型表现出传统 IT 系统不会遇到的特定漏洞。随着包含 ML 组件的系统变得越来越普遍,为安全从业人员提供针对特定 AI-ML 管道量身定制的威胁建模至关重要。目前,在识别和分析针对 ML 技术的威胁时,尚无成熟的方法来考虑整个 ML 生命周期。在本文中,我们提出了一种以资产为中心的方法——STRIDE-AI——用于评估基于 AI-ML 的系统的安全性。我们讨论如何应用 FMEA 流程来确定在 ML 生命周期的不同阶段生成和使用的资产可能如何失效。通过将 Microsoft 的 STRIDE 方法应用于 AI-ML 领域,我们将潜在的 ML 故障模式映射到威胁以及这些威胁可能危及的安全属性。所提出的方法可以帮助 ML 从业者选择最有效的安全控制措施来保护 ML 资产。我们借助从 TOREADOR H2020 项目中选择的真实用例来说明 STRIDE-AI。

使用 STRIDE 建模对 AI-ML 系统的威胁