机构名称:

¥ 6.0

Devlin, Jacob 等人。“Bert:用于语言理解的深度双向转换器的预训练。”arXiv 预印本 arXiv:1810.04805 (2018)。Radford, Alec 等人。“语言模型是无监督的多任务学习者。”OpenAI 博客 1.8 (2019):9。Brown, Tom 等人。“语言模型是少数学习者。”神经信息处理系统进展 33 (2020):1877-1901。Chowdhery, Aakanksha 等人。“Palm:使用路径扩展语言建模。”arXiv 预印本 arXiv:2204.02311 (2022)。

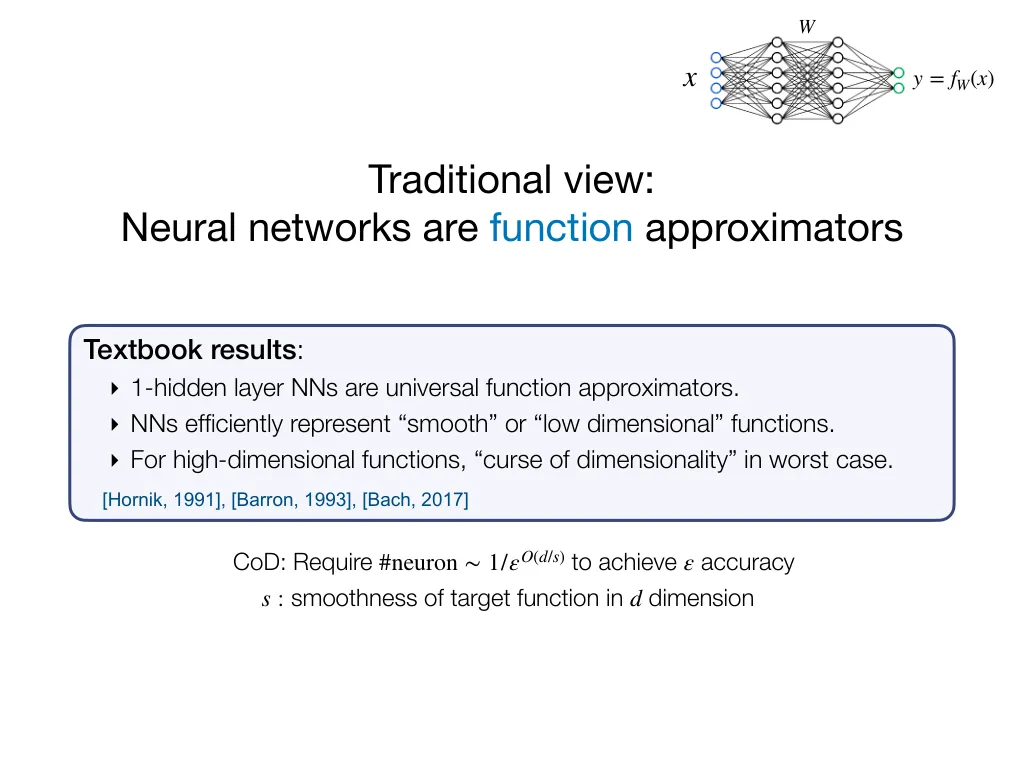

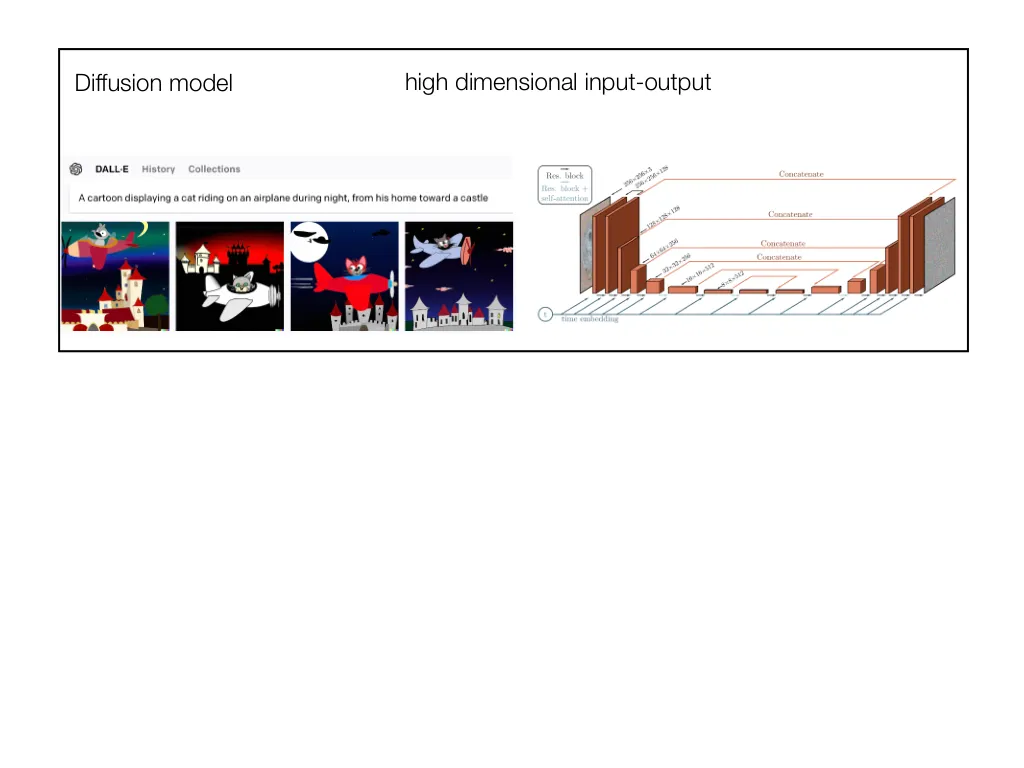

重新审视神经网络近似理论...

主要关键词