机构名称:

¥ 1.0

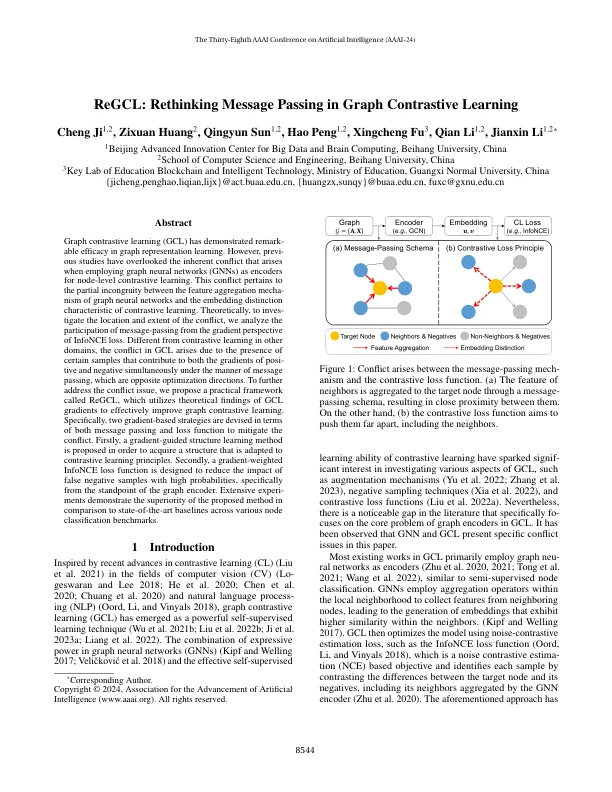

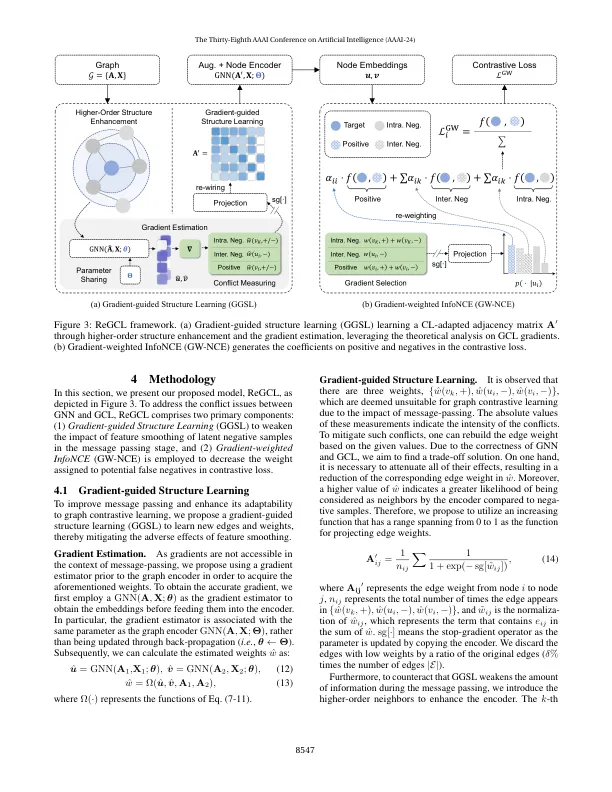

图对比学习(GCL)在图表示学习中表现出了显著的功效。然而,先前的研究忽略了在使用图神经网络(GNN)作为节点级对比学习的编码器时出现的内在冲突。这种冲突属于图神经网络的特征聚合机制与对比学习的嵌入区分特性之间的部分不协调。理论上,为了研究冲突的位置和程度,我们从 InfoNCE 损失的梯度角度分析了消息传递的参与。与其他领域的对比学习不同,GCL 中的冲突是由于在消息传递的方式下,某些样本同时对正向和负向的梯度有贡献,这是相反的优化方向。为了进一步解决冲突问题,我们提出了一个称为 ReGCL 的实用框架,它利用 GCL 梯度的理论发现来有效地改进图对比学习。具体而言,在消息传递和损失函数方面设计了两种基于梯度的策略来缓解冲突。首先,提出了一种梯度引导结构学习方法,以获得适应对比学习原理的结构。其次,设计了一种梯度加权的 InfoNCE 损失函数来降低高概率假阴性样本的影响,特别是从图编码器的角度来看。大量实验证明了所提出的方法与各种节点分类基准中最先进的基线相比具有优越性。

重新思考图对比学习中的消息传递

主要关键词

![自我学习报告 - 重新认证 [第 2 周期]](/simg/0/0016f00853b046b276e2af48e4bcd4cca2d7aad1.webp)