机构名称:

¥ 1.0

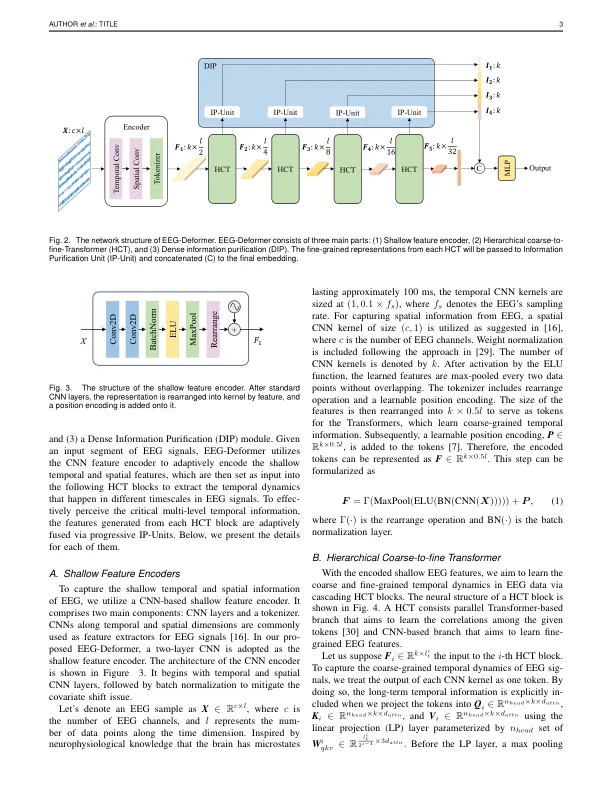

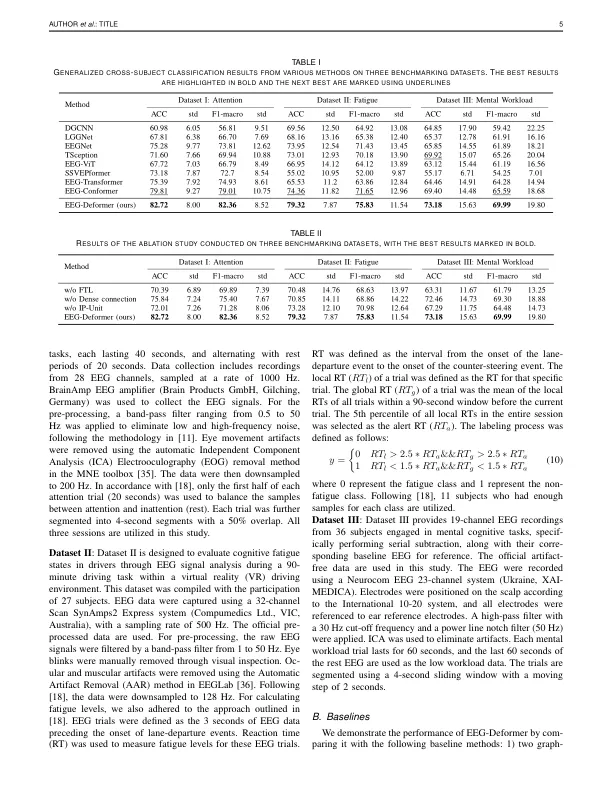

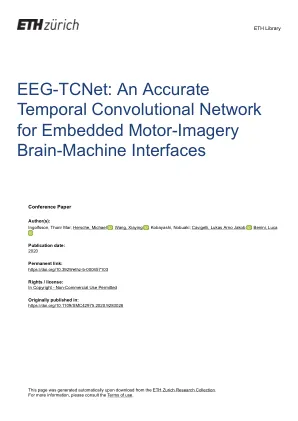

摘要 — 有效学习脑电图 (EEG) 信号中的时间动态具有挑战性,但对于使用脑机接口 (BCI) 解码大脑活动至关重要。尽管 Transformers 因其长期顺序学习能力在 BCI 领域广受欢迎,但大多数将 Transformers 与卷积神经网络 (CNN) 相结合的方法都无法捕捉 EEG 信号从粗到细的时间动态。为了克服这一限制,我们引入了 EEG-Deformer,它将两个主要的新组件合并到 CNN-Transformer 中:(1) 分层粗到细 Transformer (HCT) 块,将细粒度时间学习 (FTL) 分支集成到 Transformers 中,有效辨别从粗到细的时间模式;(2) 密集信息净化 (DIP) 模块,利用多级、净化的时间信息来提高解码准确性。对三项代表性认知任务(认知注意力、驾驶疲劳和心理负荷检测)进行的全面实验一致证实了我们提出的 EEG-Deformer 的通用性,表明它的表现优于或与现有的最先进方法相当。可视化结果表明,EEG-Deformer 从神经生理学上有意义的大脑区域学习相应的认知任务。源代码可在 https://github.com/yi-ding-cs/EEG-Deformer 找到。

EEG-Deformer:用于脑机接口的密集卷积变换器

主要关键词