机构名称:

¥ 1.0

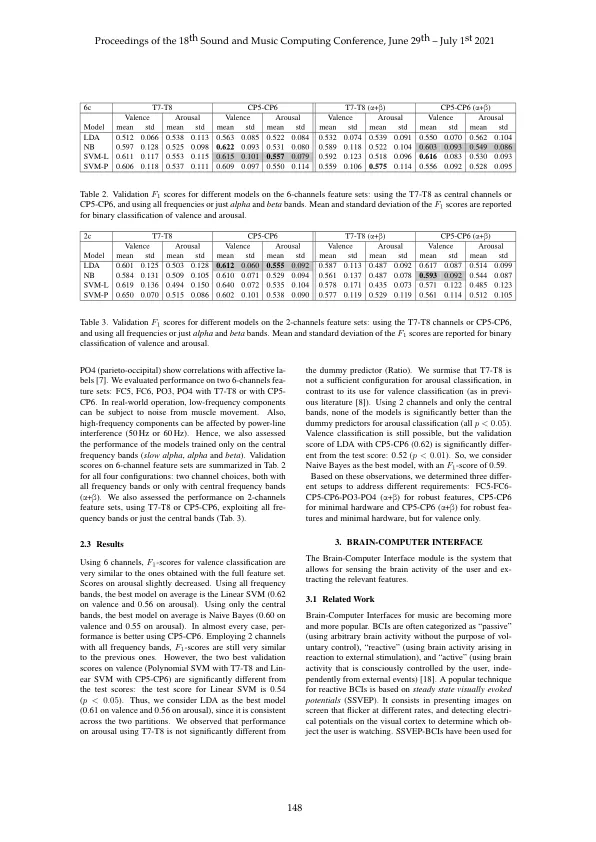

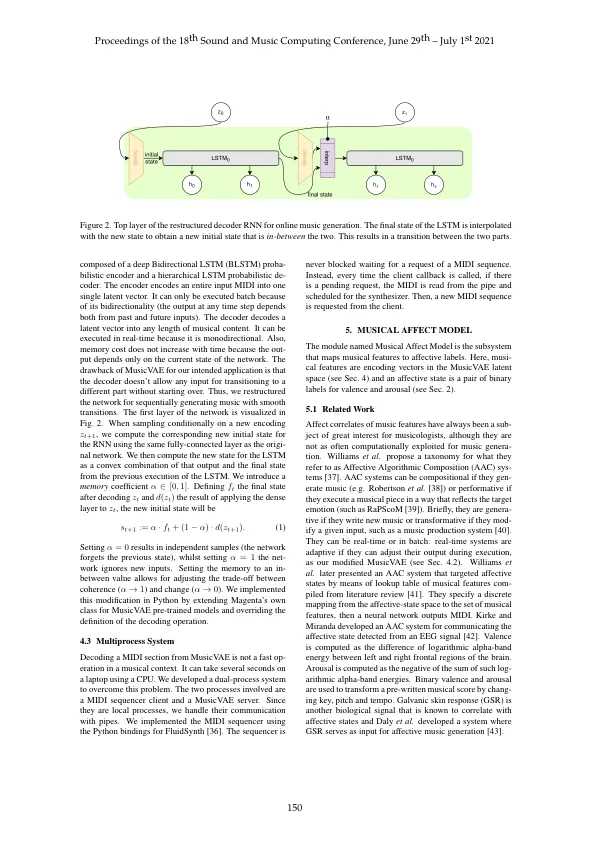

我们提出了一种实时生成音乐的方法,该方法由从脑电图 (EEG) 估计的用户情感状态驱动。这项工作旨在探索使用传感器数据的实时音乐生成应用策略。应用范围从用于 x-reality 的响应音乐到艺术装置,以及在教学环境中作为反馈的音乐生成。我们在开源平台 OpenViBE 中开发了一个脑机接口。它管理与 EEG 设备的通信并计算相关特征。基准数据集用于评估监督学习方法在价态和唤醒的二元分类任务上的表现。我们还使用减少数量的电极和频带评估了性能,以解决预算较低和环境嘈杂的问题。然后,我们解决了实时音乐生成模型的要求,并提出了对 Magenta 的 MusicVAE 的修改,引入了一个用于控制批次间内存的参数。最后,我们讨论了将所需音乐特征映射到模型的原生输入特征的可能策略。我们提出了一个概率图形模型来模拟从效价/唤醒到 MusicVAE 潜在变量的映射。我们还解决了数据集维度问题,提出了三个概率解决方案。

通过脑机接口生成

主要关键词