机构名称:

¥ 2.0

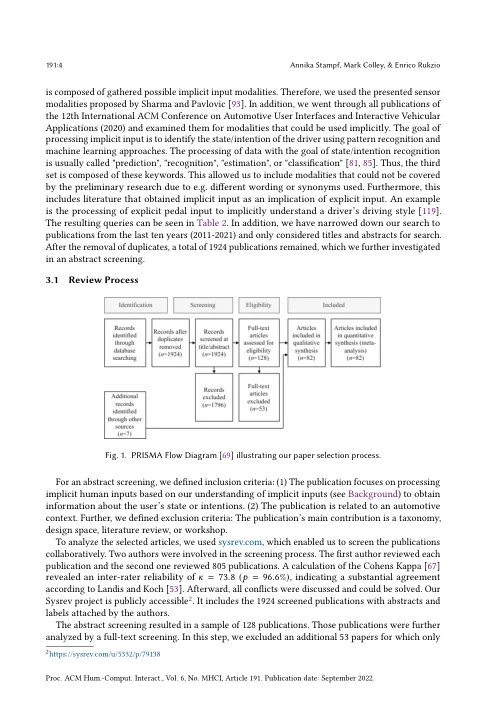

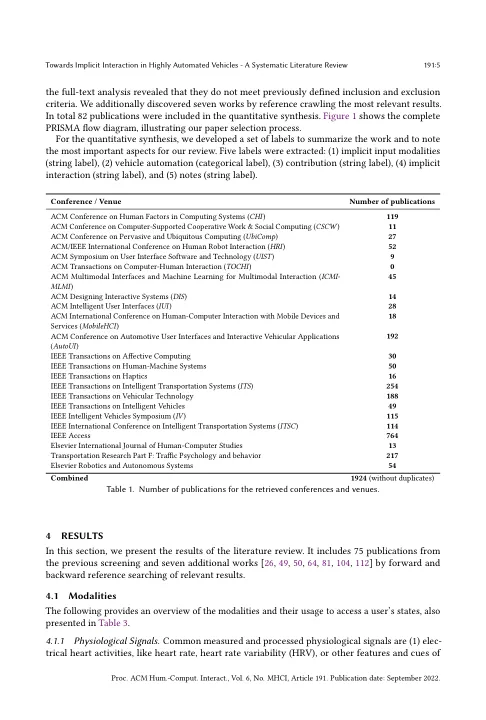

随着自动化程度的提高,车内交互可能会发生根本性变化。车辆中集成的传感器数量不断增加、机器学习取得重大进展以及处理能力的增强,使得驾驶员行为可以被实时捕捉和解读[73]。这一发展使得创新的交互成为可能,如车载情感语音助手[15]。人机集成[32,72]或共生交互[59]等领域的研究趋势也反映了这一点。然而,到目前为止,车内交互主要基于显式的直接驾驶员输入,如语音或触摸输入,或直接操作旋钮或控制杆[23]。相比之下,人际交流高度基于隐性动作和行为,如姿势或面部表情。因此,即使他人没有明确地传达这些状态,我们也能够对其状态做出陈述并进行互动[91]。隐性输入已经在高级驾驶辅助系统(ADAS)中发挥着重要作用。例如,可以通过生理信号识别驾驶员的困倦、压力、疲劳或注意力分散[95,107]。随着自动化程度的提高,车辆将接管

迈向高度自动化车辆的隐性交互