机构名称:

¥ 1.0

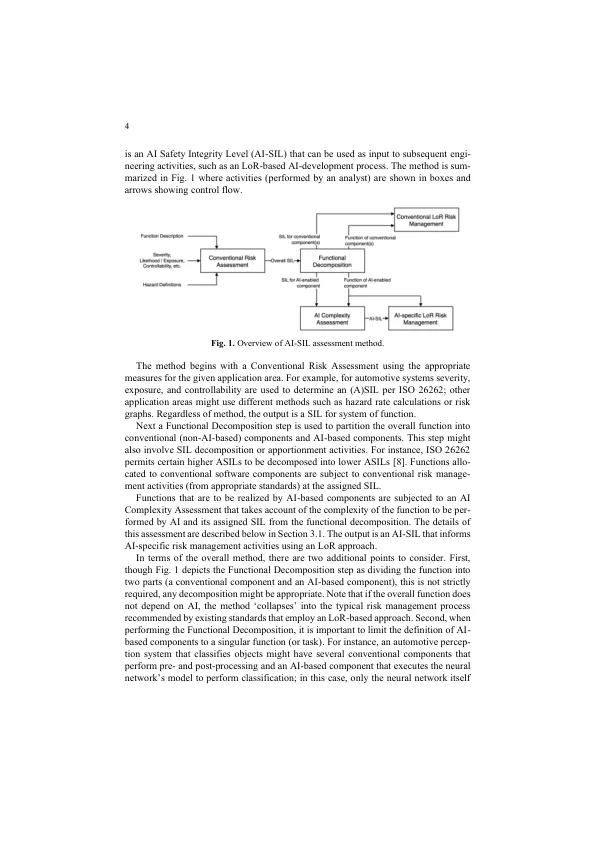

摘要。人工智能(AI)和机器学习(ML)技术正在迅速采用以在关键系统中执行与安全有关的任务。这些基于AI的系统构成了重大挑战,特别是在其保证方面。在国际公认的标准中定义的现有安全方法,例如ISO 26262,UL 4600,EN 50126和IEC 61508,尚未提供有关如何确保基于AI的系统的详细指南。对于常规(非AI)系统,这些标准采用了“严格水平”(LOR)方法,随着与系统相关的风险增加,需要越来越多的苛刻的工程活动。本文提出了对现有LOR的扩展,该扩展是由基于AI的组件执行的任务的复杂性。的复杂性是根据输入熵和输出非确定性评估的,然后与分配的安全完整性水平(SIL)相结合以产生AI-SIL。应将AI-SIL用作LOR保证方法的一部分,以确定基于AI的系统的开发和验证的适当措施和技术。通过几个自动驾驶的示例说明了所提出的扩展。

人工智能的安全完整性水平

主要关键词