机构名称:

¥ 2.0

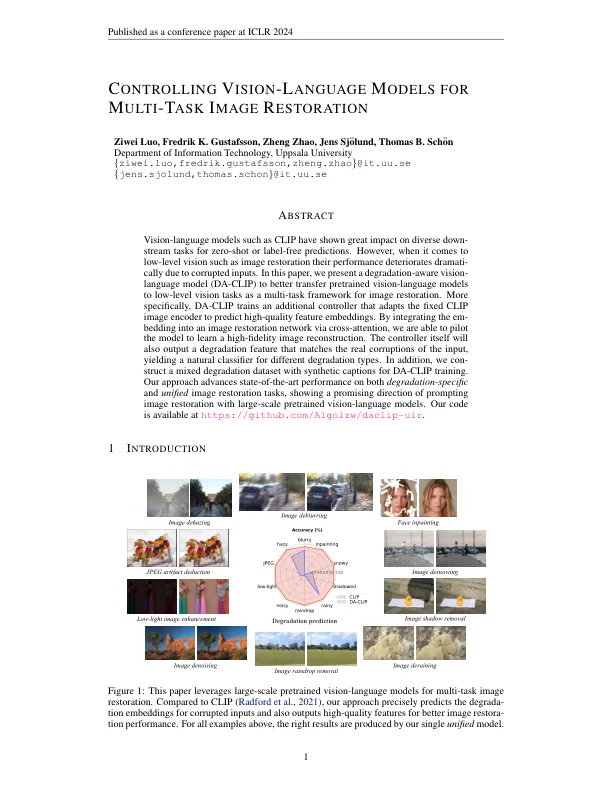

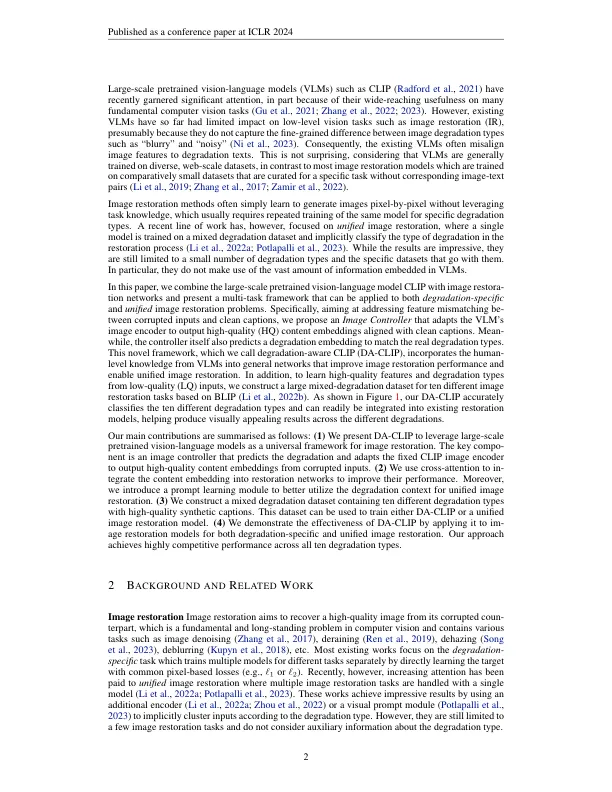

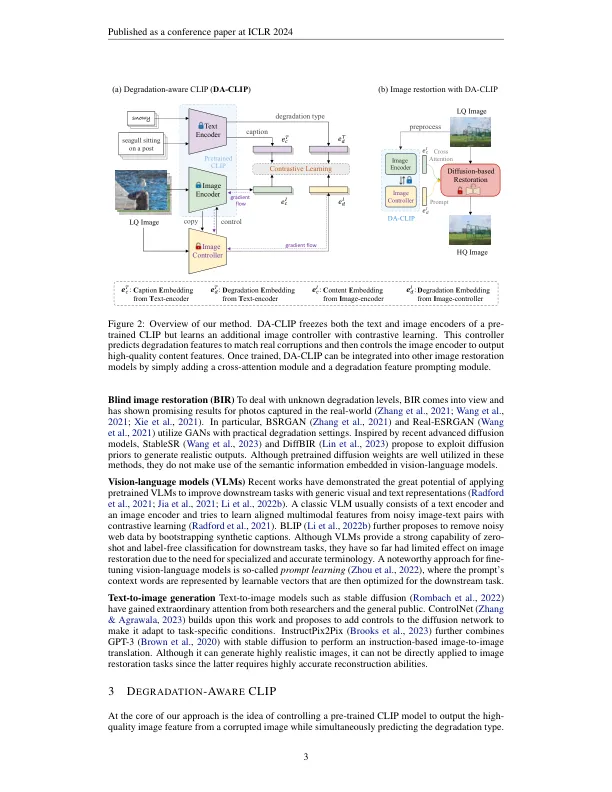

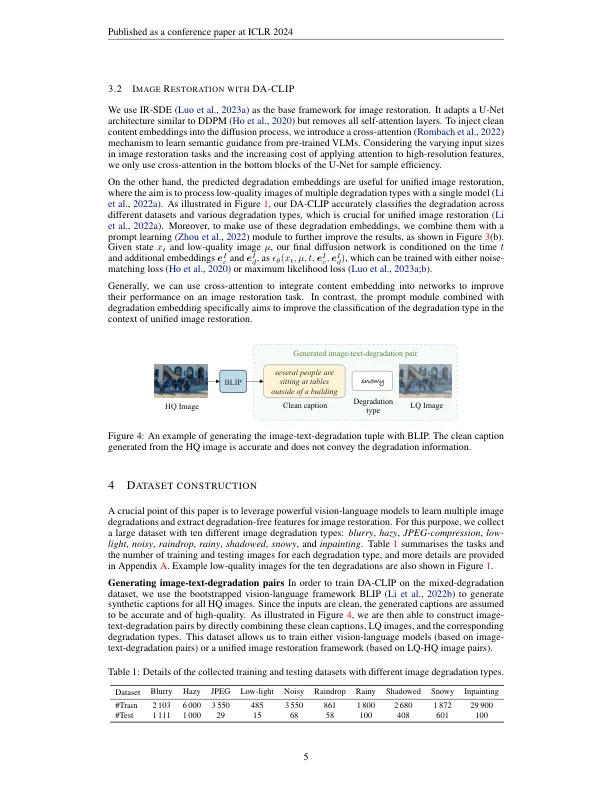

视觉语言模型(例如剪辑)对零拍或无标签预测的各种下流任务显示出很大的影响。但是,当涉及到低级视觉时,例如图像恢复其性能会由于输入损坏而急剧下降。在本文中,我们提出了一种退化感知的视觉模型(DA-CLIP),以更好地将预验证的视觉模型转移到低级视觉任务中,作为用于图像恢复的多任务框架。更具体地说,DA-CLIP训练一个额外的控制器,该控制器适应固定的剪辑图像编码器以预测高质量的特征嵌入。通过通过交叉注意将床上用品集成到图像恢复网络中,我们能够试行该模型以学习高保真图像重建。控制器本身还将输出与输入的真实损坏相匹配的降级功能,从而为不同的降解类型产生天然分类器。此外,我们将混合降解数据集与合成字幕结构为DA-CLIP训练。我们的方法在特定于降解和统一的图像恢复任务上提高了最先进的性能,显示出具有大规模预处理视觉模型促使图像恢复的有希望的方向。我们的代码可在https://github.com/algolzw/daclip-uir上找到。

控制...

主要关键词