机构名称:

¥ 1.0

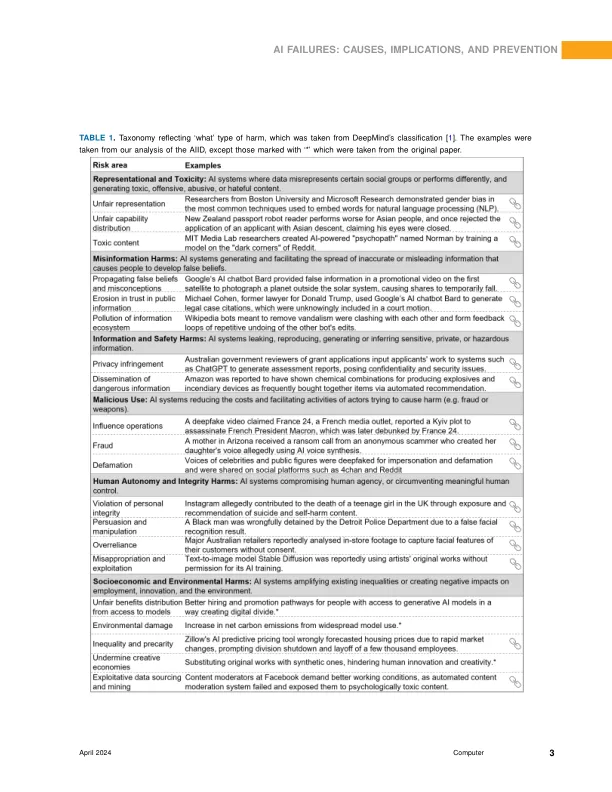

摘要 - 举报旨在提高透明度的AI事件的努力,但是系统的研究很少。为了解决这个问题,我们分析了新出现的AI事件数据库中的所有639个现实事件,设计了一个侧重于评估事件,地点,谁,谁和尺寸的事件的道德框架。对于每个事件,我们都会归类“什么”危害类型,发现恶意意图并不常见。我们确定了“危害”起源的“位置”,发现大多数损害发生在人类互动中而不是在模型开发阶段,强调了发展中社会技术考虑的需求。我们遭受了“谁”的伤害,发现影响公司的事件可能不足,强调需要在公司内进行更好的报告方法。最后,我们评估了“如何在道德上判断”危害:根据当前法规,有些事件被认为是低风险的,但仍然被认为是道德上错误的。

解码现实世界AI事件