机构名称:

¥ 1.0

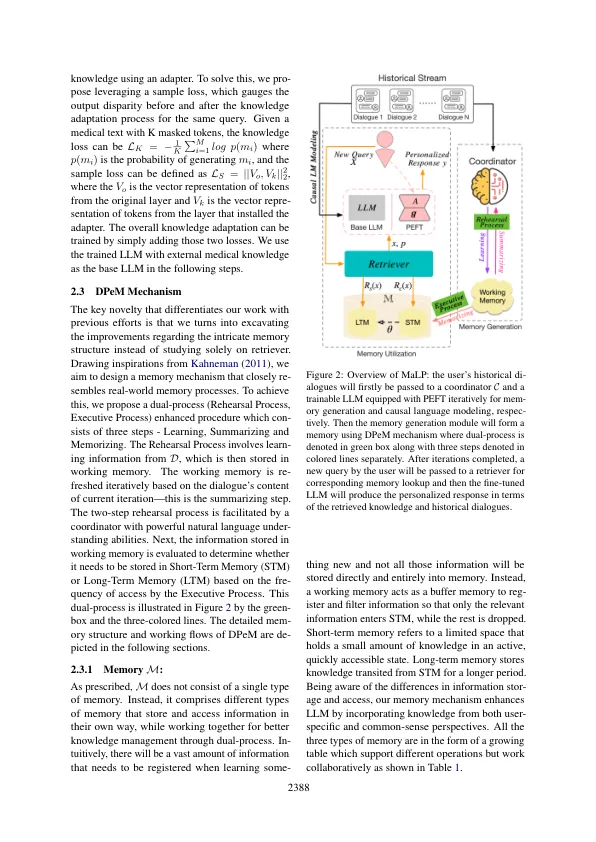

大型语言模型(LLM),例如GPT3.5,在理解和产生自然语言方面表现出非常熟练的熟练程度。另一方面,医疗助理具有为个人提供可观利益的潜力。但是,基于LLM的个性化医疗助理探索相对稀缺。通常,患者会根据其背景和偏好方式不同,这需要使以用户为导向的医疗助理进行任务。虽然可以完全训练LLM以实现此目标,但资源消耗是无法承受的。先前的研究探索了基于内存的方法,以增强对话中的新查询错误,以增强响应。我们认为,单纯的内存模块是不足的,并且充分训练LLM的成本可能过高。在这项研究中,我们提出了一种新型的计算仿生记忆机械,配备了一个有效的细调(PEFT)模式,以个性化医疗助手。为了鼓励对该领域的进一步研究,我们正在发布基于开源的语料库生成的新对话数据集和我们的实施代码1。

基于LLM的医疗助理个性化