机构名称:

¥ 3.0

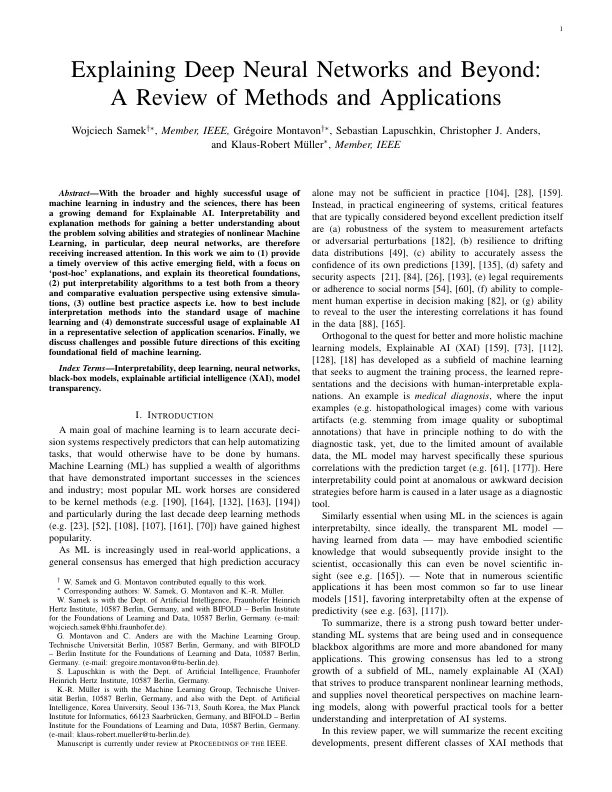

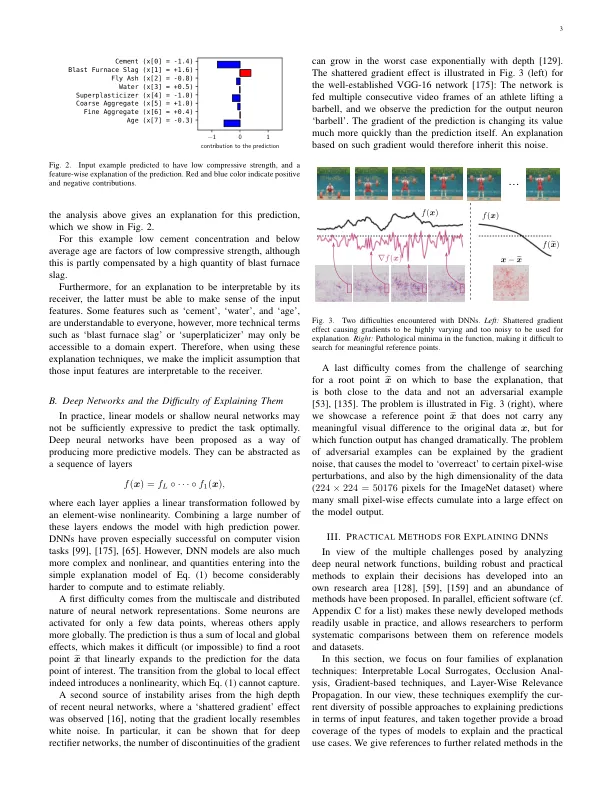

摘要 — 随着机器学习在工业和科学领域得到更广泛和高度成功的应用,对可解释人工智能的需求日益增长。因此,可解释性和解释方法正受到越来越多的关注,以便更好地理解非线性机器学习(特别是深度神经网络)的解决问题的能力和策略。在这项工作中,我们的目标是 (1) 及时概述这一活跃的新兴领域,重点关注“事后”解释,并解释其理论基础;(2) 使用大量模拟从理论和比较评估的角度对可解释性算法进行测试;(3) 概述最佳实践方面,即如何最好地将解释方法纳入机器学习的标准使用中;(4) 在具有代表性的应用场景中展示可解释人工智能的成功使用。最后,我们讨论了这一令人兴奋的机器学习基础领域面临的挑战和未来可能的方向。

解释深度神经网络及其他