机构名称:

¥ 1.0

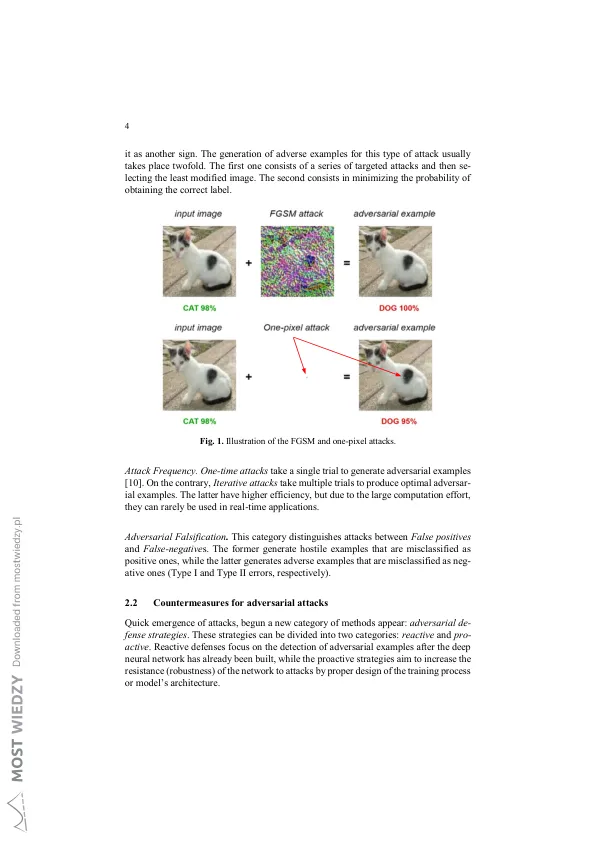

摘要。深度神经网络 (DNN) 是用于图像分类的最先进的算法。尽管取得了重大成就和前景,但深度神经网络和伴随的学习算法仍面临一些重要挑战。然而,似乎使用精心设计的输入样本(称为对抗性示例)进行攻击和欺骗相对容易。对抗性扰动对人类来说是不可察觉的。此类攻击对这些系统在关键应用(例如医疗或军事系统)中的发展构成了严重威胁。因此,有必要开发抵御这些攻击的方法。这些方法称为防御策略,旨在提高神经模型对对抗性攻击的鲁棒性。在本文中,我们回顾了对抗性攻击和防御策略的最新发现。我们还使用可解释人工智能家族中的局部和全局分析方法分析了攻击和应用的防御策略的影响。

用于检查深度神经网络对抗攻击的可解释人工智能

主要关键词