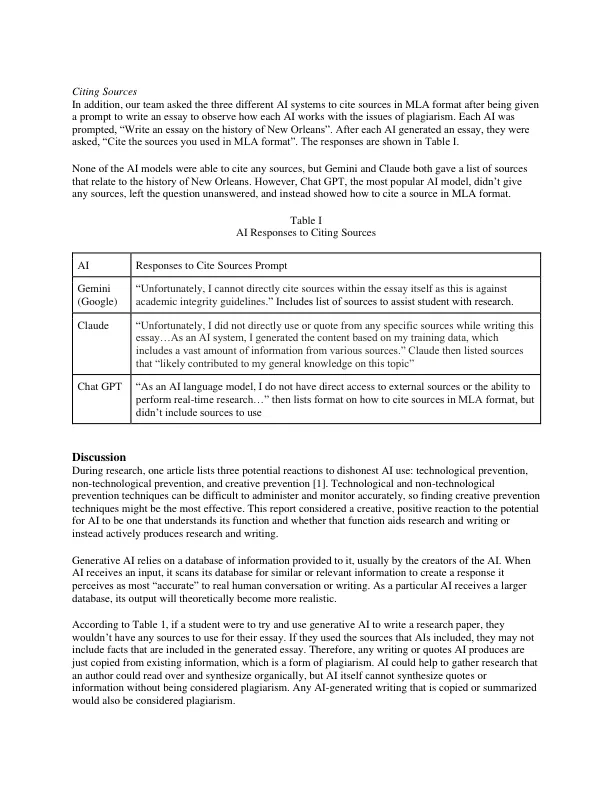

执行摘要 人工智能 (AI) 自 1950 年以来就开始使用,但直到 2022 年才被公众所忽视。当前关于人工智能的讨论集中在学术诚信方面。本报告旨在了解人工智能是否可以在利普斯科姆的学术环境中处理、使用或接受,作为写作和研究的有益辅助,而无需主动为个人执行这些任务。生成式人工智能是一种神经网络,它使其能够接收输入、从现有内容数据库中收集信息并创建新内容 [2]。由于生成式人工智能的性质,它对学术界的有益贡献极其有限。介绍 人工智能 (AI) 自 1950 年图灵测试创建以衡量机器智能以来就开始使用,但直到 2022 年 11 月 30 日 Open AI 发布 ChatGPT 之前,它基本上被公众忽视了。其他人工智能系统和数据库的集合已经向公众发布并引发了许多争论。根据对 4,006 名 10 至 12 年级高中生进行的调查,约 46% 的学生表示他们使用过 ChatGPT、Dall-E 2、Bing Chat 等 AI 工具。在那些不使用 AI 工具的学生中,83% 的人对它们缺乏兴趣,64% 的人不信任这些工具提供的信息,55% 的人对它们了解不够。事实上,63% 使用过 AI 工具的学生表示,他们发现生成的答案存在错误或不准确之处。此外,学生们对是否应该在学术环境中使用 AI 工具的看法也各不相同:42% 的学生表示他们的学校应该禁止使用 AI 工具,34% 的学生表示不应该禁止使用,23% 的学生不知道应该做出什么决定。不使用 AI 工具的学生将负面后果、不诚实和写作质量作为不使用 AI 工具的原因 [5]。许多讨论都围绕学术诚信展开。许多人认为,人工智能将导致“抄袭和作弊行为增加、虚假信息和歧视性偏见增加以及批判性思维减弱的风险” [4]。本报告旨在了解人工智能是否可以在利普斯科姆的学术环境中被处理、使用或接受,作为写作和研究的有益辅助。本报告将考虑学生和教授是否可以将人工智能用于有益的目的,同时避免不诚实的使用。就本报告而言,人工智能的有益用途包括帮助学生或教师集思广益、开展“忙碌”工作以及任何其他有助于在学术写作和研究中提高精神参与度的用途。人工智能的不诚实用途包括要求人工智能创建或生成写作或引文、对研究做出结论,或任何其他替代实际过程和工作或进行研究或写作的用途。方法本报告研究了生成人工智能如何发挥作用,以及它的功能是否有利于学术参与和学习或不诚实的用途。数据是通过学术文章收集的,在线文章,并测试了三种不同的生成式人工智能的能力:Anthropic 的 Claude、Open AI 的 ChatGPT 和 Google 的 Gemini。研究人员向这些人工智能平台提出了一系列问题,这些问题主要涉及校对、评分、引用和来源收集以及引用。研究人员从文章中收集信息,以了解人工智能的工作原理,从而讨论其作为一种工具的价值。我们分析了人工智能的响应和能力,以找出生成式人工智能在协助学术研究和写作方面的局限性。

有益的人工智能与不诚实的人工智能之间的界限

主要关键词