机构名称:

¥ 1.0

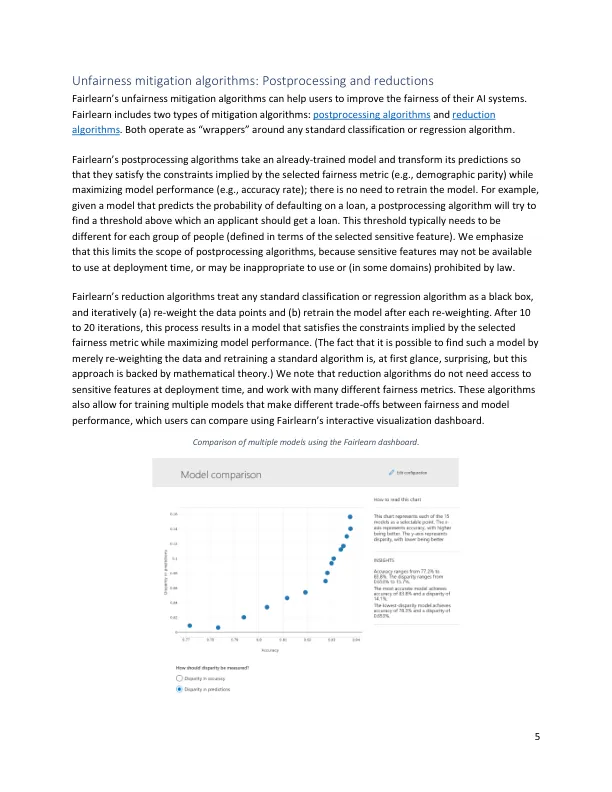

我们推出了 Fairlearn,这是一个开源工具包,它使数据科学家和开发人员能够评估和提高其 AI 系统的公平性。Fairlearn 有两个组件:交互式可视化仪表板和不公平缓解算法。这些组件旨在帮助在公平性和模型性能之间进行权衡。我们强调,在 AI 系统中优先考虑公平性是一项社会技术挑战。由于不公平的来源有很多种——有些是社会的,有些是技术的——因此不可能完全“消除”一个系统的偏见或保证公平性;目标是尽可能减轻与公平相关的危害。随着 Fairlearn 不断发展,包括更多的公平指标、不公平缓解算法和可视化功能,我们希望它能够由一个多元化的利益相关者社区塑造,从数据科学家、开发人员和业务决策者到生活可能受到 AI 系统预测影响的人们。

Fairlearn:评估和提高人工智能公平性的工具包