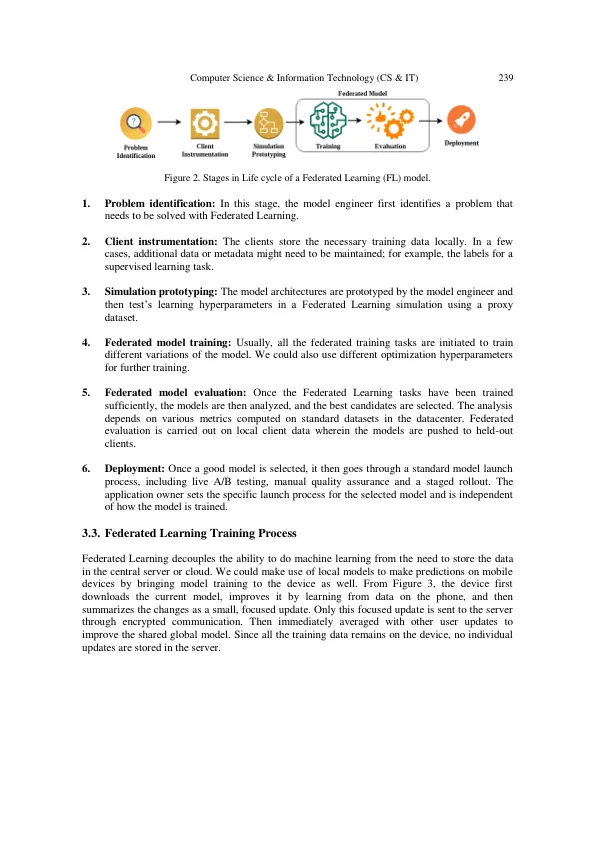

摘要 人工智能 (AI) 和机器学习模型面临的重大挑战之一是保护数据隐私和确保数据安全。解决这个问题导致了联邦学习 (FL) 机制在数据隐私保护中的应用。保护欧盟 (EU) 的用户隐私必须遵守《通用数据保护条例》(GDPR)。因此,探索用于保护数据隐私的机器学习模型必须考虑到 GDPR。在本文中,我们详细介绍了联邦机器学习、各种联邦架构以及不同的隐私保护机制。这项调查工作的主要目标是强调现有的隐私技术并提出联邦学习在行业中的应用。最后,我们还描述了联邦学习如何成为未来研究的新兴领域,它将为 AI 和机器学习带来一个新时代。 关键词 联邦学习、人工智能、机器学习、隐私、安全、分布式学习。 1. 引言由于过去几十年人工智能和机器学习的出现,机器人、计算机视觉和游戏应用等各个领域都取得了重大进展。主要关注点之一是保护数据隐私。由于每天都会产生大量数据,因此保护数据隐私至关重要。公开数据和公司私有数据的泄露导致数据隐私问题急剧增加。通过维护特定的隐私标准来利用作为数据岛隔离的数据对于提高数据安全性至关重要。滥用用户的个人数据可能会给用户带来开销,迫使他不愿透露自己的个人信息。即使在公司和行业中,保护数据免遭数据泄露也是必不可少的,因为这会给公司带来严重后果。反过来,数据泄露会大规模影响公司的财务和商业方面,导致巨大损失。确保数据隐私的著名标准之一是欧盟的《通用数据保护条例》(GDPR)[1, 2]。 GDPR 于 2018 年提出,旨在确保每个用户的数据隐私,这反过来又促使人们在使用数据时使用符合这一标准的人工智能和机器学习框架。许多机器学习和人工智能模型需要足够的数据进行训练并生成高质量的模型。虽然模型需要使用用户数据才能为用户构建良好的预测模型,但应该有一种方法可以确保用户的隐私。很少有组织需要交换数据来协同工作,从而提高公司的绩效,

面向隐私保护 AI 的联邦学习调查

主要关键词