机构名称:

¥ 1.0

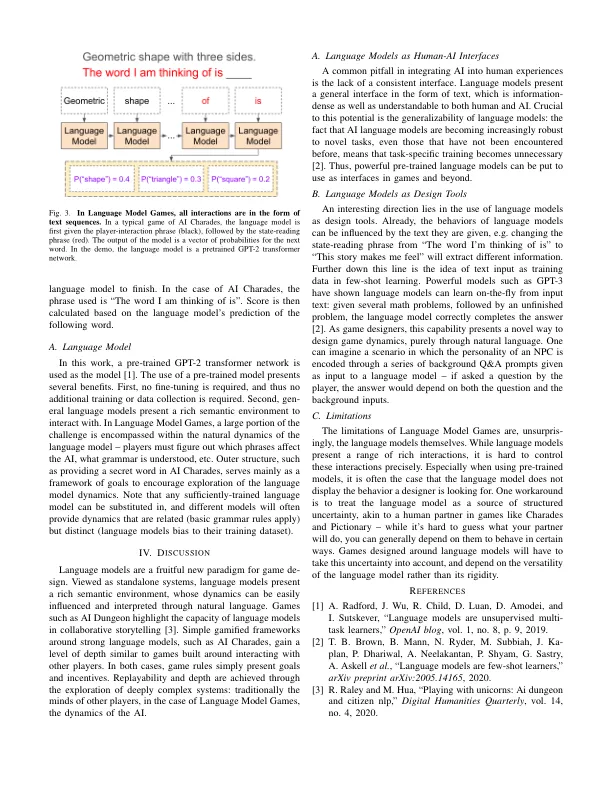

在本研究中,使用预训练的 GPT-2 Transformer 网络作为模型 [1]。使用预训练模型有几个好处。首先,不需要微调,因此不需要额外的训练或数据收集。其次,通用语言模型提供了丰富的语义环境供交互。在语言模型游戏中,很大一部分挑战包含在语言模型的自然动态中——玩家必须弄清楚哪些短语会影响 AI,理解什么语法等。外部结构,例如在 AI Charades 中提供一个秘密词,主要作为目标框架,以鼓励探索语言模型动态。请注意,任何经过充分训练的语言模型都可以替代,并且不同的模型通常会提供相关(适用基本语法规则)但不同(语言模型偏向其训练数据集)的动态。

AI Charades:语言模型作为交互式游戏环境