机构名称:

¥ 1.0

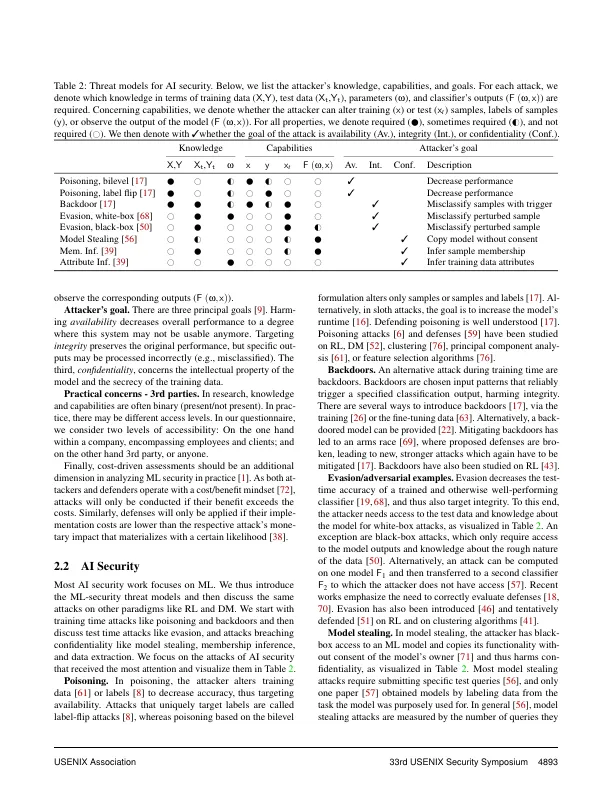

最近的研究发现了人工智能安全研究与实践之间的差距:学术界研究的威胁并不总是反映人工智能的实际用途和安全风险。例如,虽然模型通常是孤立地研究的,但在实践中,它们构成了更大的机器学习管道的一部分。最近的研究还提出,学术攻击引入的对抗性操纵是不切实际的。我们迈出了描述这种差异的全部程度的第一步。为此,我们重新审视了人工智能安全研究中研究最多的六种攻击的威胁模型,并通过对 271 名行业从业者的调查将它们与人工智能在实践中的使用情况相匹配。一方面,我们发现所有现有的威胁模型确实都适用。另一方面,存在着明显的不匹配:研究往往对攻击者过于慷慨,假设攻击者可以访问在现实世界中并不经常获得的信息。因此,我们的论文呼吁采取行动,研究更实用的人工智能安全威胁模型。

迈向人工智能安全领域更实用的威胁模型

主要关键词