机构名称:

¥ 1.0

在许多应用中,机器学习模型使用敏感信息作为训练数据或做出影响关键领域(如自动驾驶、癌症检测和生物特征认证)人员的决策。随着机器学习在关键应用中的应用越来越多,攻击的潜在影响也随之增加。旨在从模型中提取数据或操纵其决策的攻击是需要在风险评估期间考虑的威胁。使用预先训练的模型或来自外部来源的公开数据集可以降低开发 AI 系统所需的资源,但也可能引发各种攻击。数据集或模型可能会被恶意准备以在部署期间诱导特定行为,而 AI 开发人员对此并不知情。此外,过度拟合(即模型记住了训练数据但不能很好地推广到以前未见过的数据的状态)会增加从模型中提取私人信息的机会或促进更有效的规避攻击。

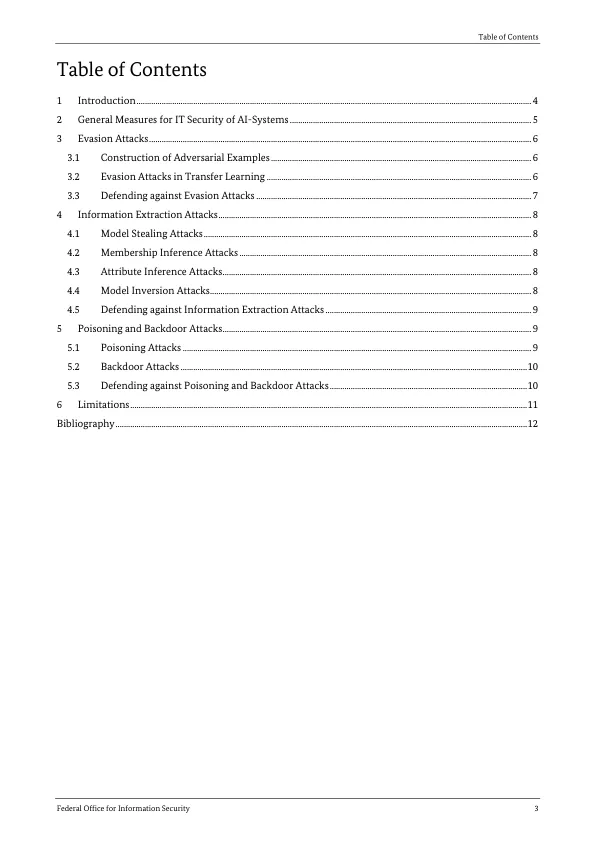

人工智能安全问题概述