机构名称:

¥ 1.0

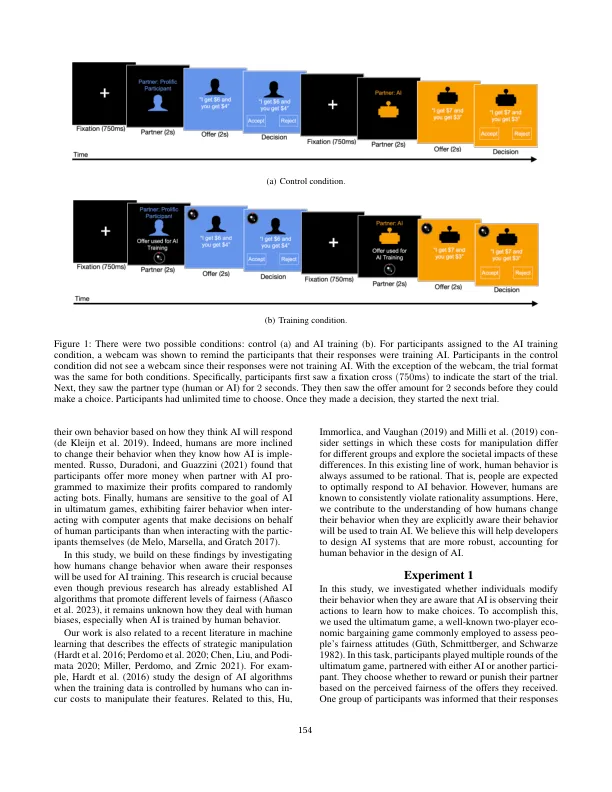

近年来,人工智能 (AI) 已成为我们日常生活中不可或缺的一部分,帮助我们做出决策。在这种交互过程中,AI 算法通常使用人类行为作为训练输入。因此,重要的是要了解人们在训练 AI 时是否会改变他们的行为,以及当训练对他们没有好处时他们是否会继续这样做。在这项工作中,我们在最后通牒游戏的背景下进行行为实验来回答这些问题。在我们的版本中,参与者被要求决定是否接受或拒绝其他人类参与者或 AI 提出的金钱分割提议。一些参与者被告知他们的选择将用于训练 AI,而其他参与者没有收到此信息。在第一个实验中,我们发现参与者愿意牺牲个人收入来训练 AI 变得公平,因为他们变得不太倾向于接受不公平的提议。第二个实验重复并扩展了这一发现,结果显示参与者有动力训练人工智能,即使他们将来永远不会遇到它。这些发现表明人类愿意付出成本来改变人工智能算法。此外,它们表明,人工智能训练过程中的人类行为不一定与基线偏好一致。这一观察结果对人工智能发展提出了挑战,表明人工智能算法在推荐选择时考虑其对行为的影响非常重要。

人类放弃奖励,为人工智能注入公平性