机构名称:

¥ 1.0

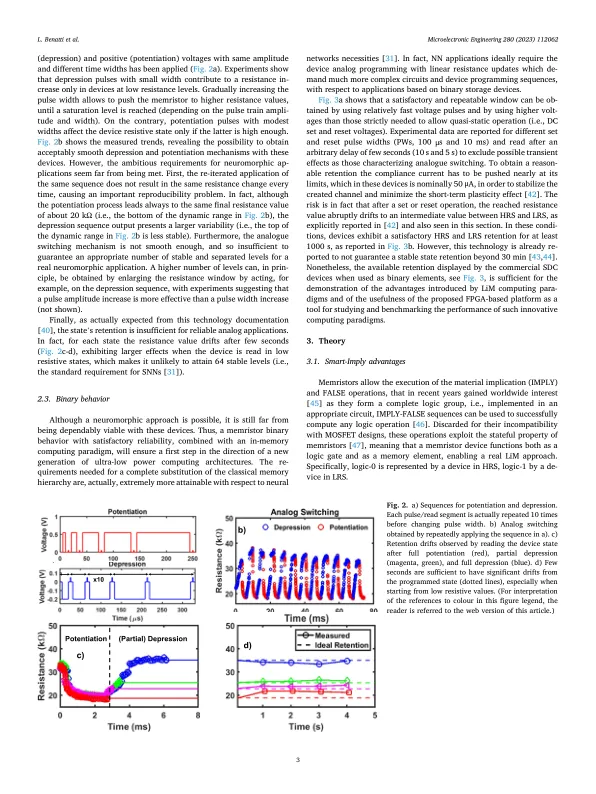

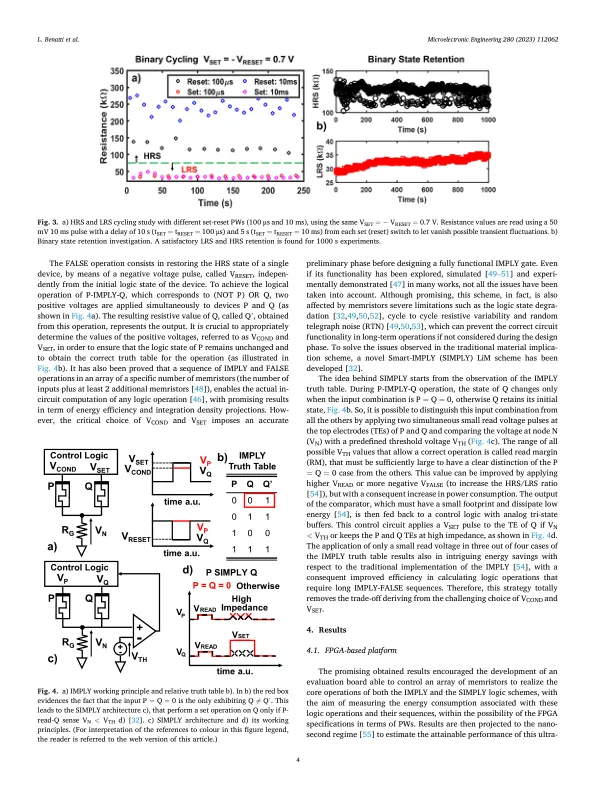

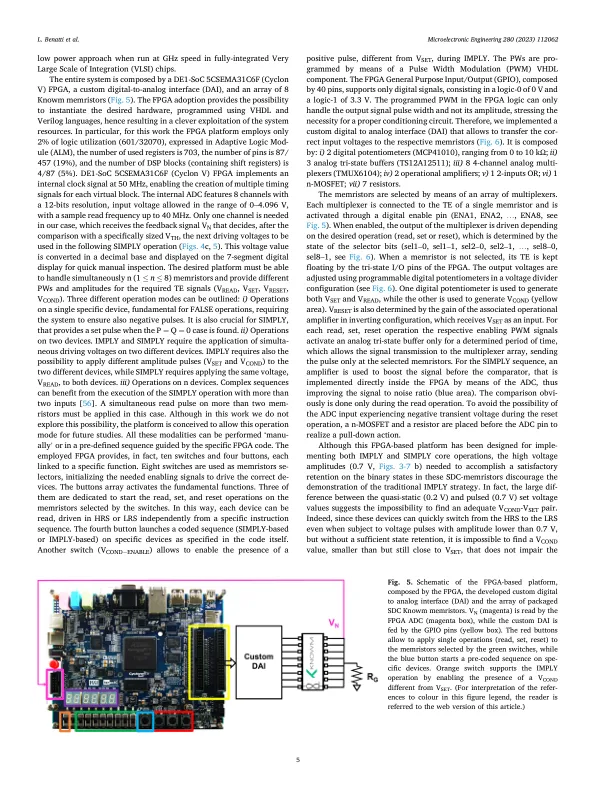

在当今的计算机技术中,降低功耗是一项日益艰巨的挑战。传统的计算架构受到所谓的冯·诺依曼瓶颈 (VNB) 的影响,即需要在内存和处理单元之间不断交换数据和指令,从而导致大量且似乎不可避免的功耗。即使是通常用于运行人工智能 (AI) 算法(例如深度神经网络 (DNN))的硬件也受到此限制的影响。为了满足对超低功耗、自主和智能系统日益增长的需求,必须改变范式。从这个角度来看,新兴的忆阻非易失性存储器被认为是引领这项技术向下一代硬件平台过渡的良好候选者,它使在同一位置存储和处理信息成为可能,从而绕过 VNB。为了评估当前公共可用设备的状态,本文对商用级封装的自导通道忆阻器进行了彻底研究,以评估其在内存计算框架中的性能。具体而言,确定了允许突触权重的模拟更新和稳定的二进制切换的操作条件以及相关问题。为此,设计并实现了基于 FPGA 控制平台的专用但原型的系统。然后,利用它充分表征创新智能 IMPLY(SIMPLY)逻辑内存(LiM)计算框架的功耗性能,该框架允许可靠地在内存中计算经典布尔运算。将这些结果投影到纳秒范围可以估算出这种计算范式的真正潜力。虽然本文没有进行研究,但所提出的平台也可用于测试基于忆阻器的 SNN 和二值化 DNN(即 BNN),它们可与 LiM 结合以提供异构灵活架构,这是无处不在的 AI 的长期目标。

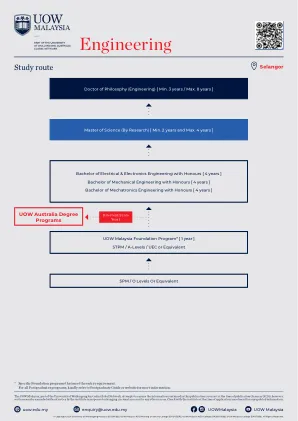

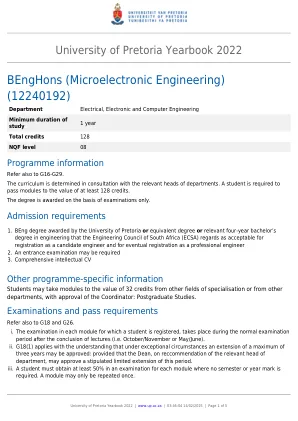

微电子工程

主要关键词