机构名称:

¥ 1.0

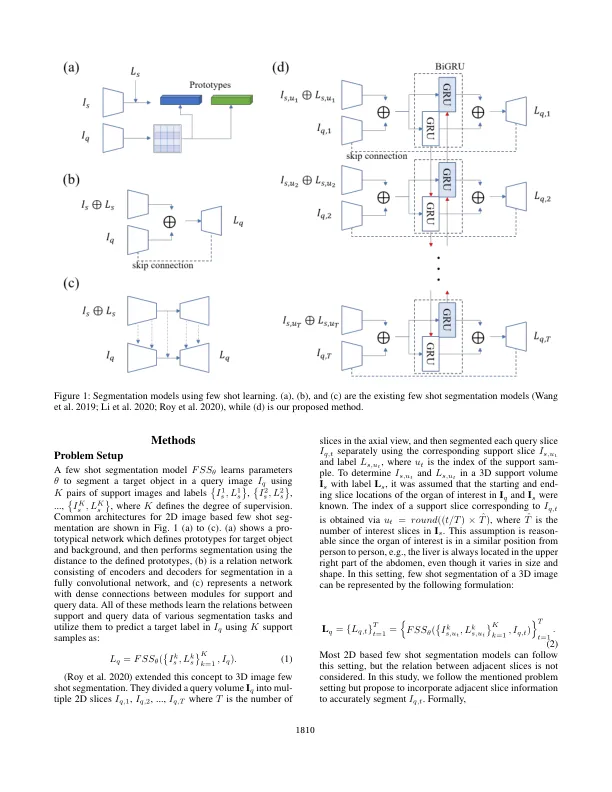

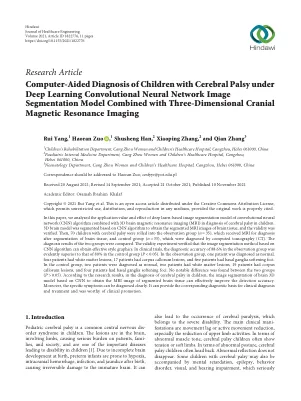

在3D医学图像中对感兴趣的器官进行分割是准确诊断和纵向研究的必要条件。尽管使用深度学习的最新进展已显示出许多细分任务的成功,但是高性能需要大的数据集,而注释过程既耗时又耗时。在本文中,我们提出了一个3D少数射击分割框架,以使用目标器官注释的有限训练样本进行准确的器官序列。为了实现这一目标,像U-NET一样的网络旨在通过了解支持数据的2D片与查询图像之间的关系,包括辅助门控复发单元(GRU),该单元(GRU)了解相邻切片之间编码特征的一致性。此外,我们会介绍一种传输学习方法,以通过在支持数据中采样的任意支持和查询数据进行测试之前对模型进行更新,以适应目标图像和器官的特征。我们使用带有不同器官注释的三个3D CT数据集评估了我们提出的模型。我们的模型比最先进的射击分段模型产生了显着提高的性能,并且与经过更多目标培训数据训练的完全监督模型相当。

基于双向RNN的3D医疗图像分割的少数射击学习

主要关键词