机构名称:

¥ 1.0

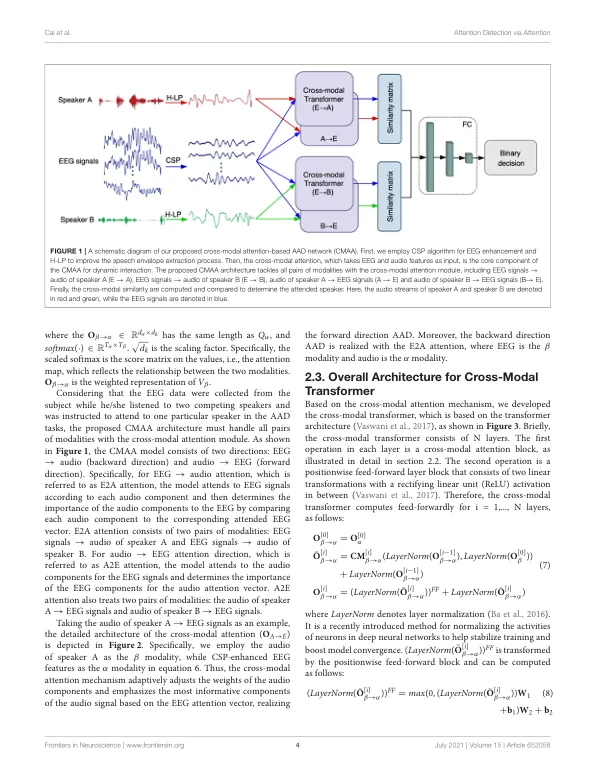

人类表现出非凡的感知能力,可以在多个竞争演讲者中选择感兴趣的语音流。先前的研究表明,通过分析听众的脑电图(EEG)活动,可以推断出听觉注意检测(AAD)可以推断出哪些说话者。但是,以前的AAD方法在短信号段上的表现较差,需要更高级的解码策略来实现强大的实时AAD。在这项研究中,我们提出了一种新颖的方法,即基于跨模式的基于跨模式的AAD(CMAA),以利用歧视性特征和音频和EEG信号之间的相关性。使用这种机制,我们希望通过直接参与音频和脑电图功能来动态地调整相互作用和融合横向模式信息,从而检测出在脑信号中表现出的听觉注意活动。我们还通过数据可视化和公开可用数据库的全面实验来验证CMAA模型。实验表明,CMAA在1-、2-和5-S决策窗口下分别达到82.8、86.4和87.6%的准确性值,分别为厌食条件。对于2-S决策窗口,在现实世界中的混响条件下,平均达到84.1%。所提出的CMAA网络不仅可以比常规线性模型实现更好的性能,而且还优于最先进的非线性方法。这些结果和数据可视化表明,CMAA模型可以通过直接参与音频和脑电图功能来动态地调整交互作用和融合交叉模式信息,以提高AAD性能。

通过跨模式注意的听觉注意检测

主要关键词