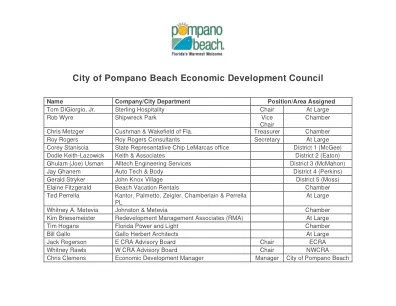

机构名称:

¥ 5.0

人工智能(AI)责任在全球和欧盟的十字路口处于十字路口。虽然从数据保护到非歧视的几项现有法律,对某些类型的AI易于危害确定责任,AI ACT和修订后的产品责任指令(PLD)是欧盟级别上的前两个法律工具,专门针对整个AI价值链中的AI系统实施全面的综合义务。在此背景下,欧洲委员会与PLD修订一起提出的人工智能责任指令(AILD)面临着关于它如何适应这个新颖的监管框架的一些挑战。无疑,AI具有从癌症筛查到欺诈检测和预防事故的巨大潜力,但也带来风险。但是,PLD并未充分涵盖广泛的AI特异性风险,尤其是与生成AI有关的风险,例如歧视和侵犯人格权利的风险。

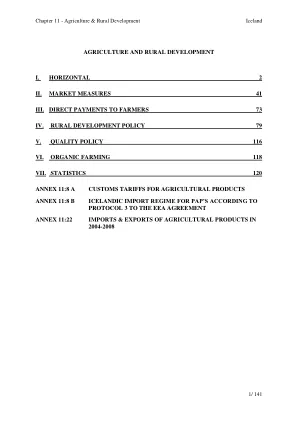

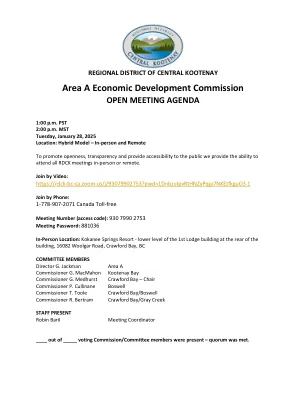

农业与农村发展委员会

主要关键词