机构名称:

¥ 6.0

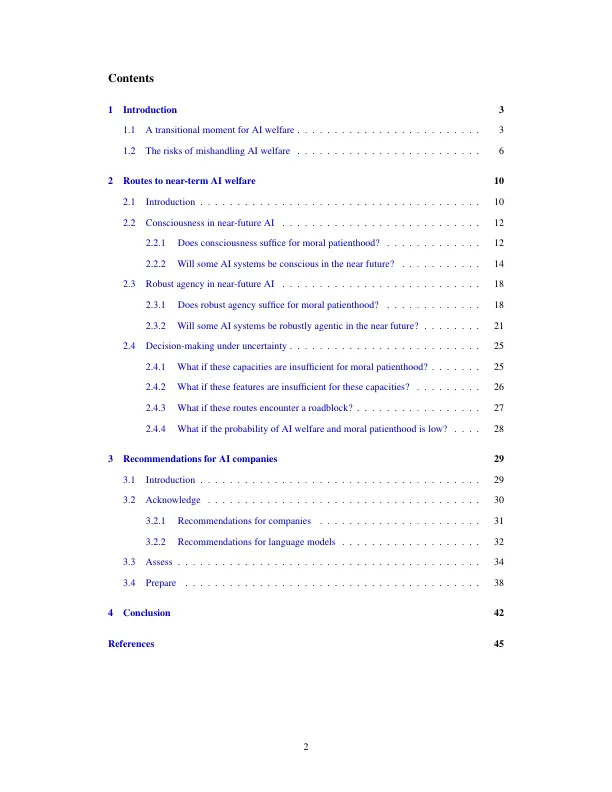

在本报告中,我们认为某些AI系统在不久的将来有意识和/或稳健的代理有现实的可能性。这意味着AI福利和道德耐心的前景(具有自身利益和道德意义的AI系统)不再是科幻或遥远的未来的问题。对于不久的将来,这是一个问题,AI公司和其他参与者有责任开始认真对待它。我们还建议AI公司和其他参与者可以采取的三个早期步骤:他们可以(1)承认,AI福利是一个重要且困难的问题(并确保语言模型输出相同),(2)开始评估AI系统以证明意识和强大的机构的证据,以及(3)准备与适当的道德相关级别处理AI系统的政策和程序。要明确的是,我们在本报告中的论点不是AI系统肯定是或将是有意识,坚固的代理或在道德上具有重要意义的。取而代之的是,我们的论点是对这些可能性存在实质性不确定性,因此我们需要提高对AI福利的理解以及对这个问题做出明智决定的能力。否则,我们会有很大的风险,我们将对AI福利的决定不当,错误地损害了道德上和/或错误地关心不做的AI系统的AI系统。

认真对待AI福利

主要关键词