机构名称:

¥ 1.0

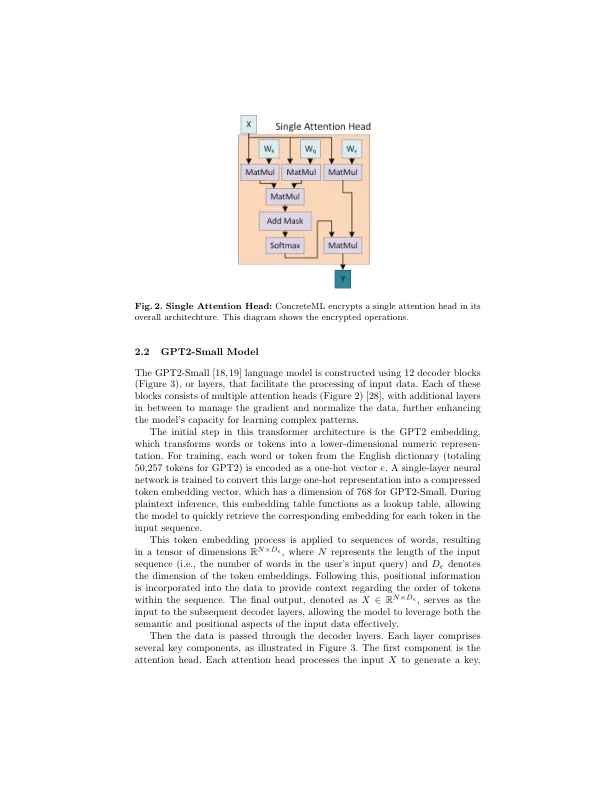

摘要。大型语言模型(LLMS)最近改变了许多行业,增强了内容生成,客户服务代理,数据分析甚至软件的生成。这些应用程序是在远程服务器上托管的十个应用程序,以保护神经网络模型IP;但是,这引起了人们对输入查询的隐私的担忧。完全同质加密(FHE)是一种允许在私人数据上进行计算的加密技术,已被提议作为解决挑战的解决方案。然而,由于LLM的大小和FHE的计算开销的增加,今天使用分型模型方法对当今的实用fhe llms进行了进程。在这里,用户将其FHE加密数据发送到服务器以运行加密的注意头层;然后,服务器返回该图层的结果,以供用户本地运行该模型的其余部分。通过采用此方法,服务器维护其模型IP的一部分,并且用户仍然可以执行私有LLM推理。在这项工作中,我们评估了单层拆分模型LLM的神经网络模型IP构图,并演示了一种新颖的攻击向量,该攻击向量使用户可以轻松从服务器中提取神经网络模型IP,从而绕开了对加密量的要求的保护措施。在我们的分析中,我们证明了这种攻击的可行性,并讨论了潜在的缓解。

sqisign2d-east:使用2 ...

主要关键词