机构名称:

¥ 2.0

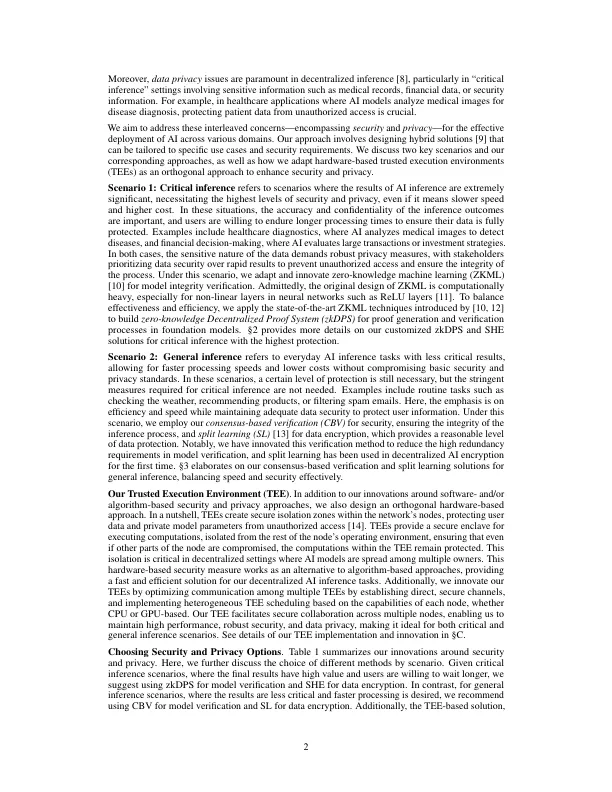

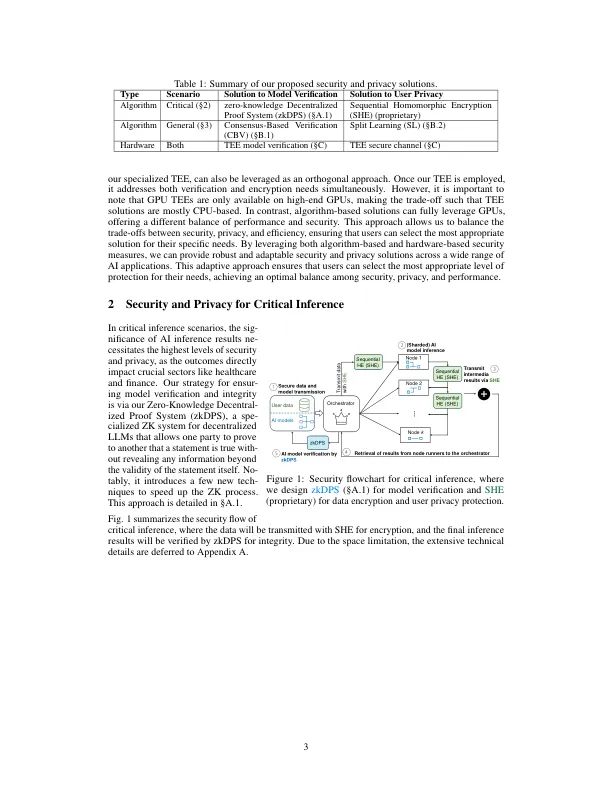

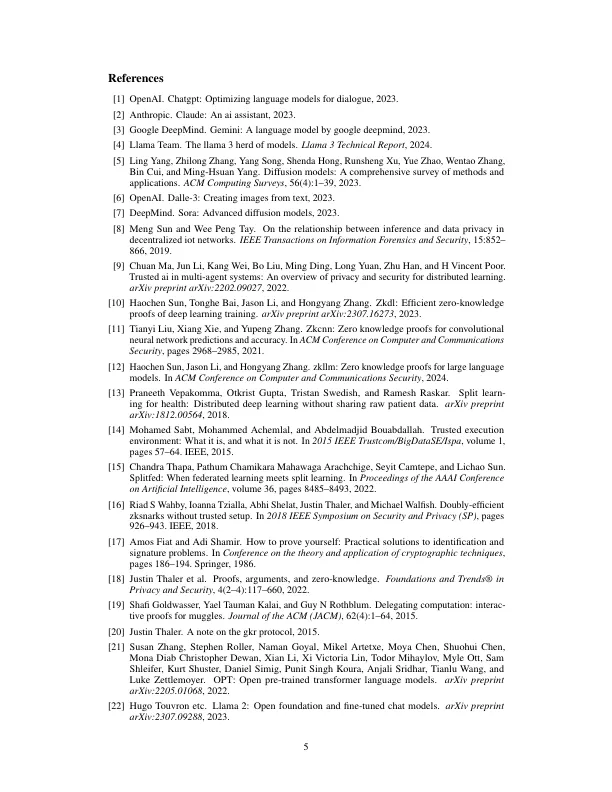

ML模型在医疗保健,财务和安全等关键领域的快速发展增强了对强大的数据安全性,模型完整性和可靠输出的需求。大型多模式基础模型,同时对于复杂任务至关重要,在可伸缩性,可靠性和潜在滥用方面面临着挑战。分权系统通过分配工作量和减轻失败的中心点来提供解决方案,但它们引入了未经授权访问跨节点敏感数据的风险。我们通过旨在负责AI开发的综合框架来应对这些挑战。我们的方法包括:1)零知识证明,以确保安全模型验证,增强信任,而不会损害实践。2)基于共识的验证检查,以确保节点之间的一致输出,减轻幻觉并维持模型完整性。3)拆分学习技术,可以将模型跨不同节点进行分割,从而通过任何时候防止完整的数据访问来保留数据隐私。4)通过受信任的执行环境(TEE)来保护数据和计算,基于硬件的安全性。此框架旨在增强安全性和隐私,并提高多模式AI系统的可靠性和公平性。促进有效的资源利用有助于更可持续的AI开发。我们的最先进的证明和原则证明了该框架在负责任地使人工智能民主化的有效性,为建立安全和私人的基础模型提供了有前途的方法。

分散推理的框架

主要关键词