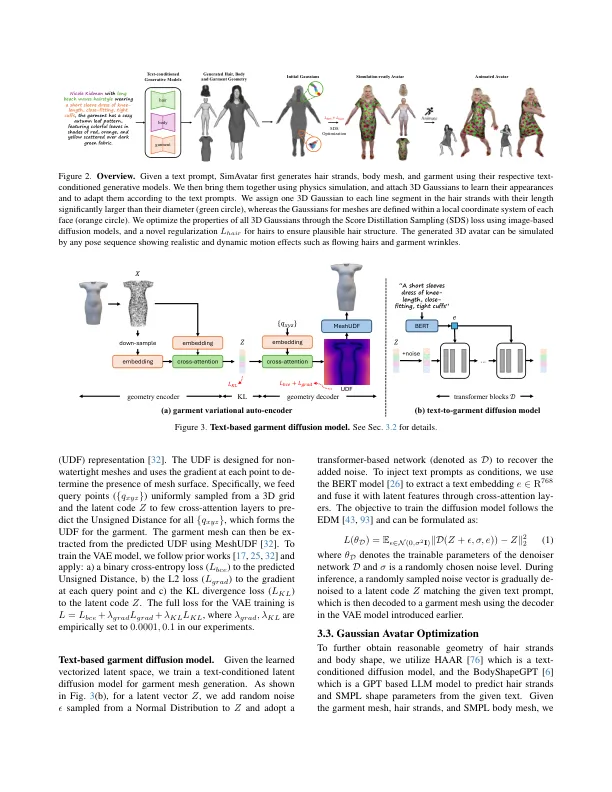

1。引言创建照片现实和动态的人类化身具有广泛的应用,包括虚拟试验,电影和游戏制作,虚拟助手,AR/VR以及远程介绍。传统上,此过程需要培训,这使得普通用户无法访问。最近,基础扩散模型的进步加速了旨在使3D Human Avatar创建民主化的研究工作,从而可以通过文本[16、46、51、88]或图像[39]易于用户控制。早期的3D人头像创作的方法将头发,身体和衣服作为单层表示,因此由于其纠缠的几何形状,很难独立模拟或编辑每个区域。为了解决这一限制,重新制作的工作使用了分层结构来分别反映身体,服装或头发[27,36,82,96]。,这些方法中的许多方法都依赖于nerf [58]等隐性代表来定义服装或毛发地理。尽管隐式表示有助于从基础扩散模型中利用先验知识,但它们在现有模拟器中进行动画挑战,这是由于身体运动而引起的头发和服装的现实运动。结果,这些方法难以生产动画时看起来很现实的化身。因此,出现了一个自然的问题:我们可以设计3D化身生成管道,该管道可以利用图像扩散模型中的丰富的先验知识,同时与现有的模拟管道兼容?解决此问题的关键挑战在于连接当前模拟器和文本驱动的头像生成管道中使用的不同表示。前者通常会重新使用平滑清洁的非紧密网格或特定设计的头发链,其拓扑是可以优化的,并且很难约束。十大的后者采用隐式表示(例如NERF [58]或SDF [83]),尽管它们可通过嘈杂的监督信号来优化来自扩散模型的嘈杂监督信号,但不能轻易地转换为适合模拟的开放网格或发束。为了解决这些问题,我们提出了一个新颖的框架Simavatar,该框架从文本提示中生成了3D人体化身,可以很容易地通过现有的头发和服装模拟器来动画。关键思想是为不同的人类部位(例如头发,身体和服装)采用合适的代表,并利用图像扩散模型和模拟器的先验知识。为此,我们提出了使用头发束代表人头发,身体和饰物的几何形状,参数身体模型SMPL [55],

带有分层头发和衣服的仿真准备头像

主要关键词