机构名称:

¥ 3.0

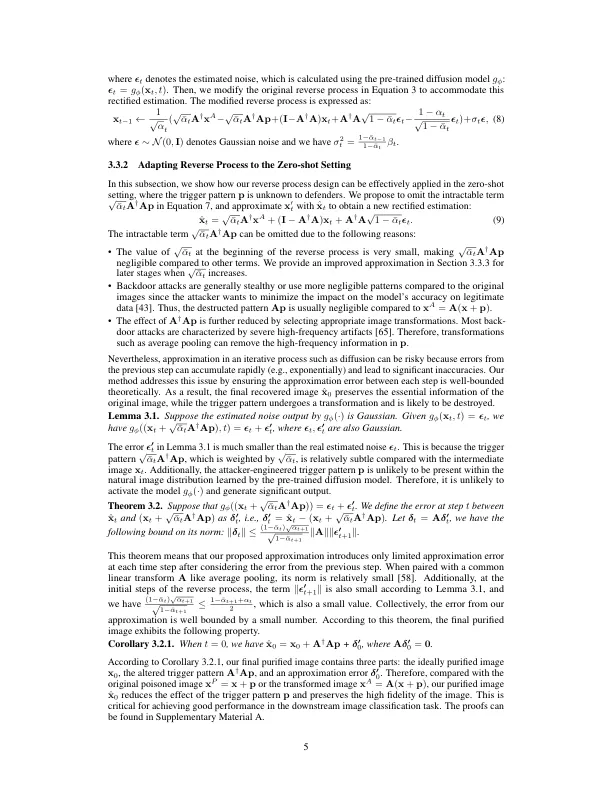

后门攻击将中毒的样本注入训练数据,从而导致模型部署期间中毒输入的分类错误。防御此类攻击是具有挑战性的,尤其是对于仅允许查询访问的现实世界黑框模型。在本文中,我们通过零照片图像纯化(ZIP)提出了一个针对后门攻击的新型防御框架。我们的框架可以应用于中毒的模型,而无需有关模型或任何清洁/有毒样品的任何先验知识的内部信息。我们的防御框架涉及两个步骤。首先,我们在中毒图像上应用线性转换(例如模糊)以破坏后门图案。然后,我们使用预训练的扩散模型来恢复转换删除的缺失语义信息。特别是,我们通过使用转换后的图像来指导高保真纯化的图像的生成,该图像在零拍设置中起作用。我们在具有不同类型的攻击的多个数据集上评估了我们的ZIP框架。实验结果表明,与最新的后门防御基线相比,我们的拉链框架的优势。我们认为,我们的结果将为黑盒模型的未来防御方法提供宝贵的见解。我们的代码可在https://github.com/sycny/zip上找到。

黑盒后门防御通过零拍图像净化

主要关键词