机构名称:

¥ 2.0

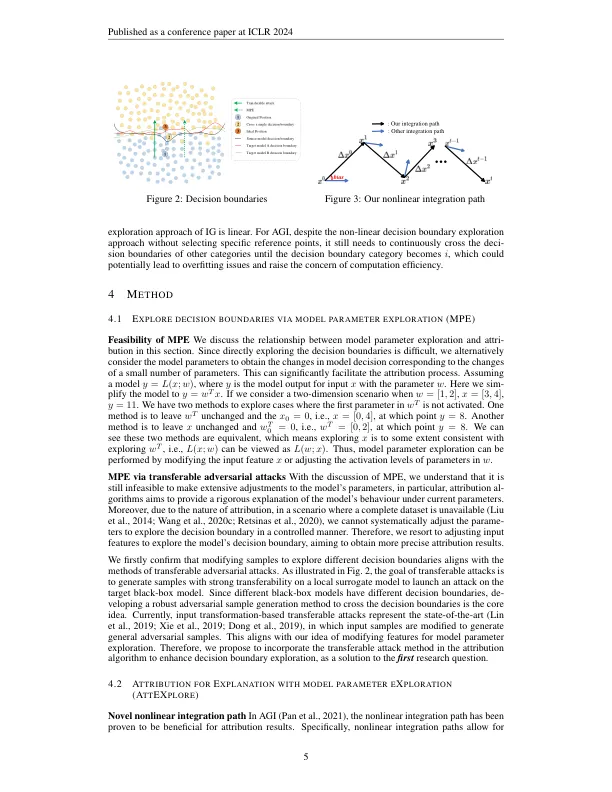

由于现实世界中的噪音和人为增强的扰动,达到深度神经网络(DNNS)的信任度是一项艰巨的任务。因此,为这些非线性和复杂的参数化模型做出的决策提供解释至关重要。归因方法对于这个目标有希望,但其性能可以进一步提高。在本文中,我们首次提出了归因的决策边界探索方法与可转移的对抗攻击的过程一致。具体而言,可转移的对抗性攻击来自源模型的一般对抗性,这与可以跨越属性中多个决策边界的副本样本的生成一致。UTI-liz liz of the Enstancions,我们通过模型Pa-Rameter探索引入了一种新颖的归因方法。此外,灵感来自研究模型参数的频率能力,我们通过基于频率信息来探索不同模型的决策范围的输入功能来为DNN提供增强的解释。大规模实验表明,使用模型参数e x ploration(attexplore)进行电子i xplanation的方法优于其他最先进的可解释性方法。此外,通过采用其他可转移攻击技术,Attexplore可以探索归因结果的潜在变化。我们的代码可在以下网址提供:https://github.com/lmbtough/attexplore。

attexplore:解释的归因

主要关键词