机构名称:

¥ 1.0

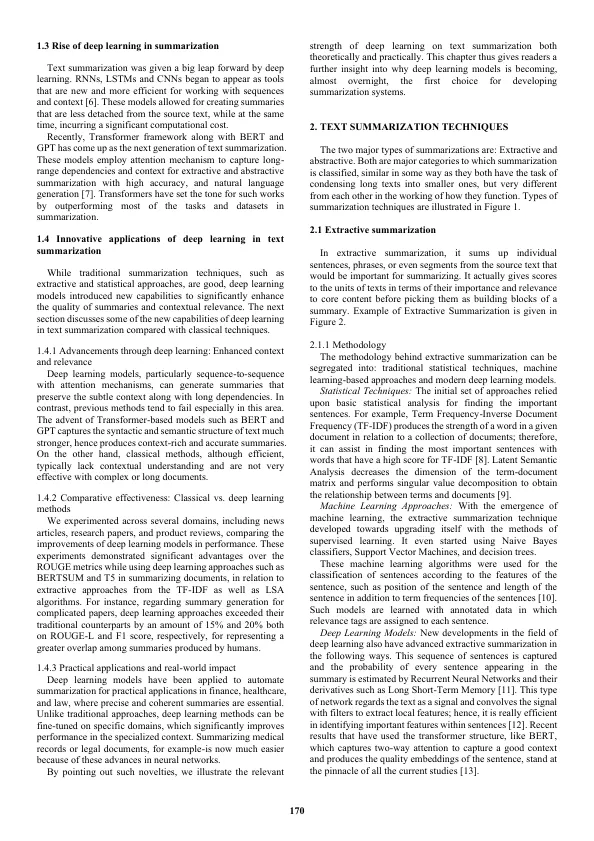

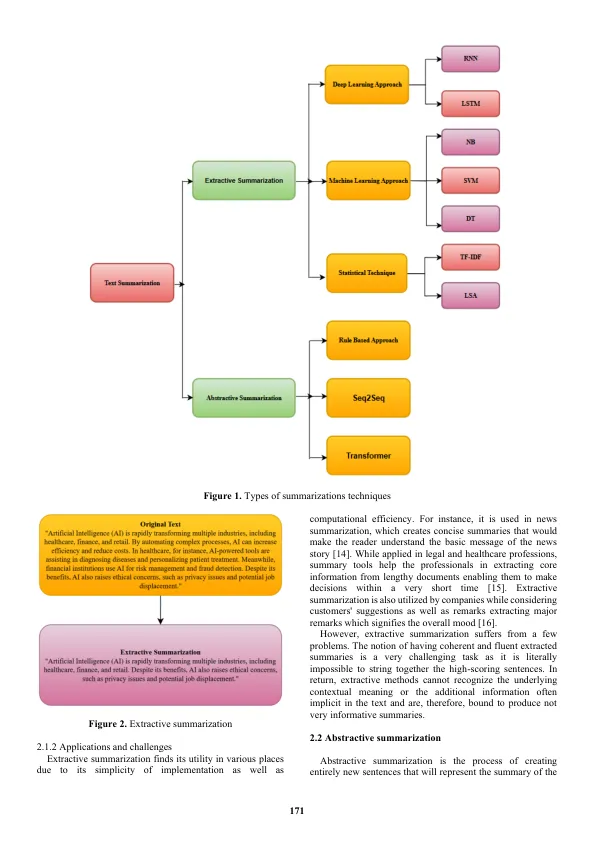

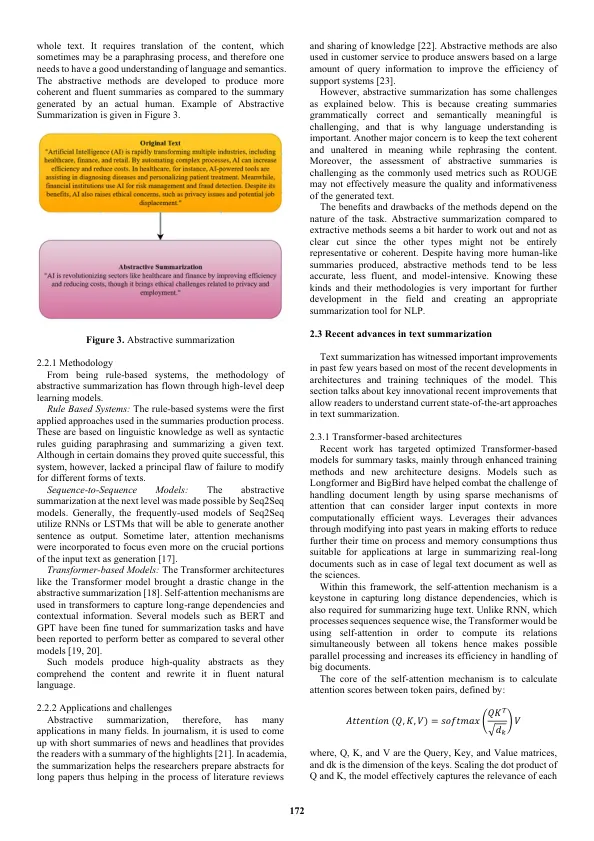

当前发生的社交媒体上基于文本的信息增加需要有效的汇总。减少文本数据是自然语言处理中最重要的任务之一,也称为文本摘要。本文通过排除的模型(包括提取模型,选择了一些整个句子和解释摘要的抽象模型)对排除和当前的摘要模型进行了文献综述。此外,它也解释了基本的统计模型,例如TF-IDF或LSA,机器学习和深度学习,并专注于基于变形金刚的模型,例如BERT或GPT,这些模型已提高了摘要质量。这些发现还显示了深度学习模型与其他传统技术之间的比较分析。摘要中的开放问题包括凝聚力,准确性和捕获长期依赖性,本文将混合动力和预训练的语言模型作为可能的解决方案。本文还指示了未来的研究领域,包括模型的效率,增强模型的事实内容以及模型的特殊目的应用。本评论为改进文本摘要方法提供了良好的背景,并使研究人员和从业人员了解当前正在做的事情以及将来可能受到影响。

统一的文本摘要方法

主要关键词