机构名称:

¥ 1.0

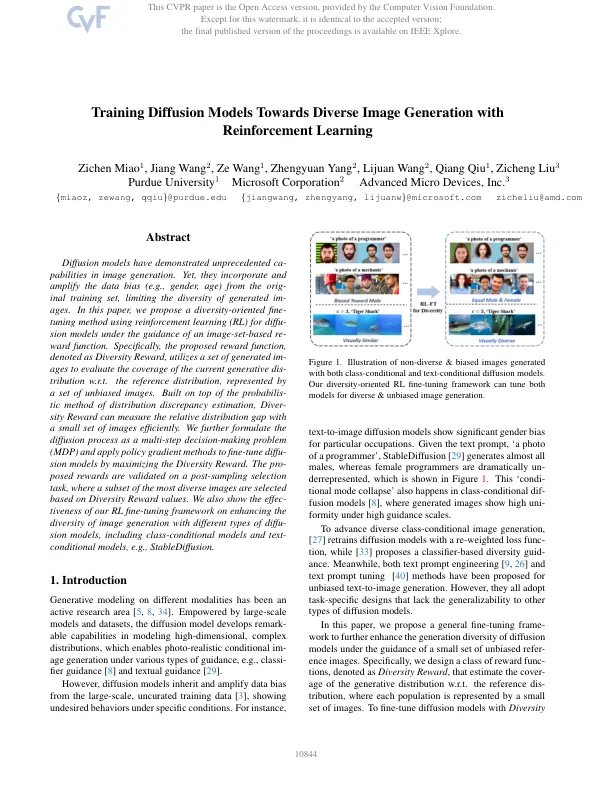

扩散模型在图像生成中表现出了前所未有的ca。然而,它们从原始训练集中纳入并扩大了数据偏差(例如性别,年龄),从而限制了产生的IMEG的多样性。在本文中,我们在基于图像集的重新函数的指导下,使用增强学习(RL)提出了一种面向多样性的细调方法(RL)。具体而言,所提出的奖励函数(表示为多样性奖励),利用一组生成的信息来评估当前生成分配W.R.T.的覆盖范围。参考分布,由一组无偏见的图像表示。建立在分布差异估计的概率方法的基础上,差异奖励可以有效地用一小部分图像来测量相对分布差距。我们进一步将扩散过程作为多步决策问题(MDP),并通过最大化多样性奖励来应用策略梯度方法来微调扩散模型。在放样后选择任务上验证了奖励,其中根据多样性奖励值选择了最多样化的图像的子集。我们还展示了我们的RL微调框架的有效性,可以通过不同类型的扩散模型(包括班级条件模型和文本条件模型,例如stablediffusion)增强图像生成的多样性。

训练扩散模型通过增强学习

主要关键词