机构名称:

¥ 1.0

摘要。安全关键系统中的人为可靠性问题(例如航空业)曾经并将继续推动基于工具或组织的保护措施的设计和使用。软件和硬件已经开发出来以克服人为可靠性,从而能够容忍和抵抗人为错误。因此,系统变得更加复杂,人与实际生产机器之间的距离从未停止增加。大多数情况下,当自动化产品成熟时,感知的复杂性会大大降低,有时在开始时很困难,从高到非常高。本文对人机系统的复杂性和认知稳定性进行了综合分析,更具体地说是高度自动化的系统。它强调了几个问题,例如技术复杂性、复杂性和专业知识、机器和人的可靠性以及复杂性和弹性。本文强调人与高度自动化的安全关键系统之间的交互。人们对与“友好”自动机的合作有何期望?他们需要了解其内部复杂性才能与它们交互吗?他们如何看待外部复杂性?安全、高效和舒适地交互所需的正确抽象级别是什么?

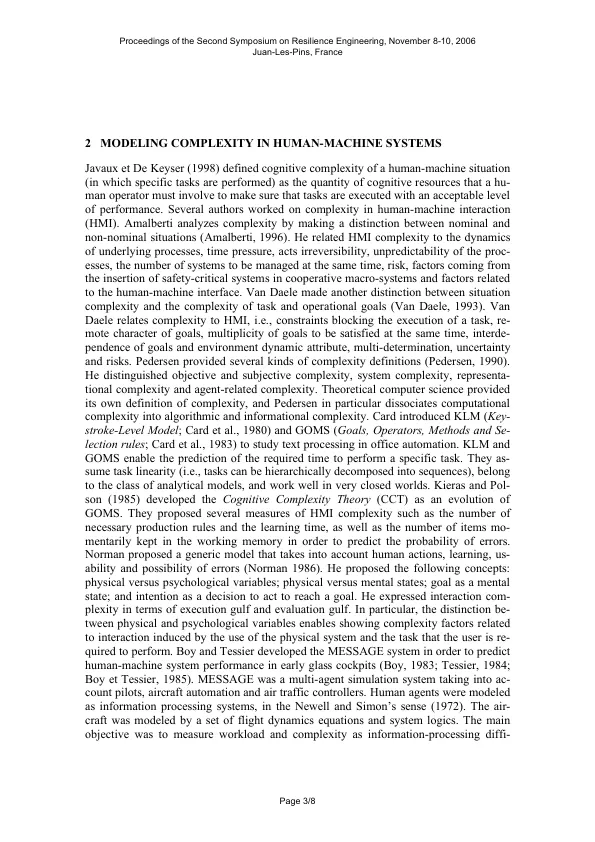

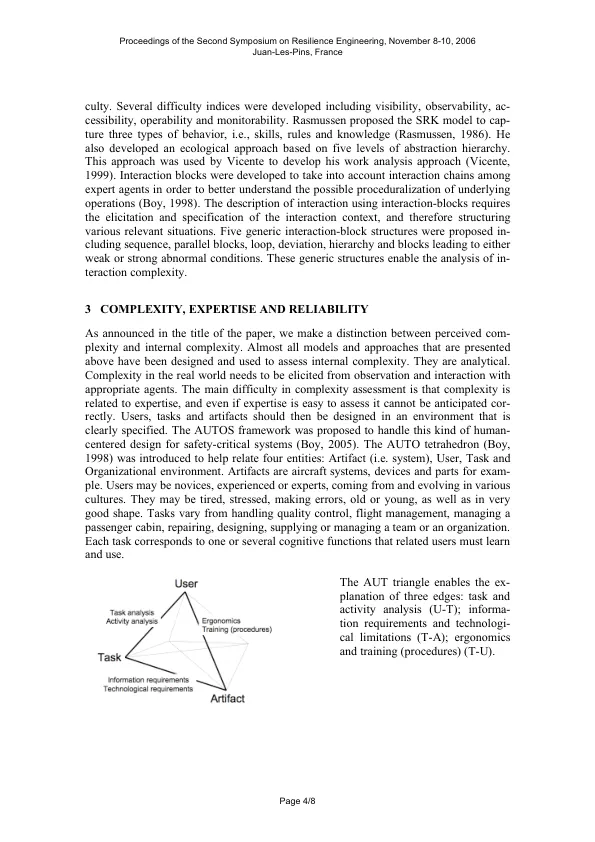

感知复杂性与内部复杂性 我们是否采取了……