机构名称:

¥ 1.0

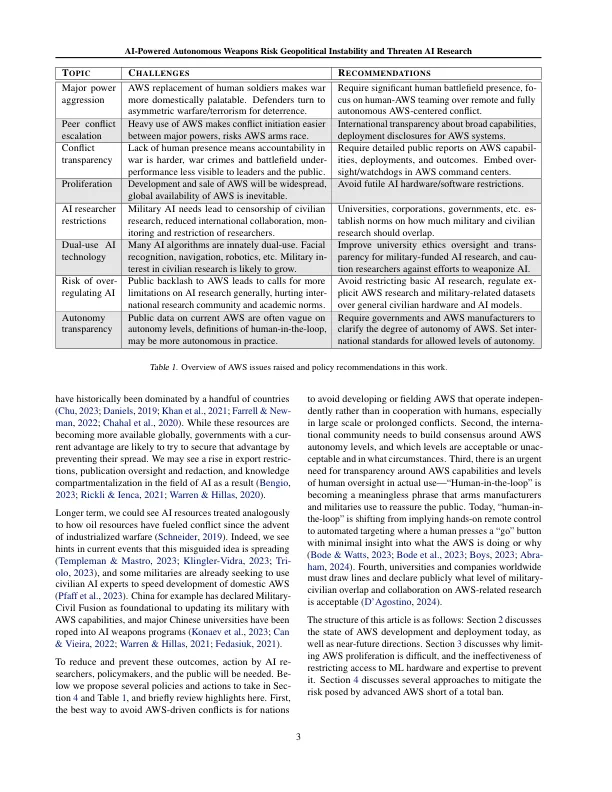

最近,机器学习 (ML) 在自主武器系统 (AWS) 开发中的应用给地缘政治稳定和人工智能研究领域的思想自由交流带来了严重风险。与超级人工智能 (AGI) 带来的风险相比,这一主题最近受到的关注较少,但对技术发展进程的假设较少,因此是一个近期问题。机器学习已经使 AWS 能够在许多战场角色中取代人类士兵,从而降低发动进攻性战争的前期人力成本,从而降低政治成本。在同等对手的情况下,这增加了“低强度”冲突的可能性,而这种冲突有升级为更大范围战争的风险。在非同等对手的情况下,它减少了侵略战争对国内的反击。无论使用军事人工智能的其他道德问题(例如平民伤亡风险)如何,这种影响都可以发生,并且不需要任何超人的人工智能能力。此外,AWS 的军事价值引发了人们对人工智能军备竞赛的担忧,以及对人工智能研究实施国家安全限制的错误做法。我们在本文中的目标是提高公众和机器学习研究人员对军事技术完全或接近完全自主所带来的近期风险的认识,并提供监管建议以减轻这些风险。我们呼吁人工智能政策专家,尤其是国防人工智能社区在开发和部署 AWS 时保持透明度和谨慎,以避免我们在此强调的对全球稳定和人工智能研究的负面影响。

人工智能自主武器可能引发地缘政治不稳定并威胁人工智能研究

主要关键词